Qwen 的新型嵌入模型系列,有三种尺寸:0.6B、4B、8B,以及两种类别:文本嵌入和文本重新排名。

完整的数据集可以在 Hugging Face 上浏览。最小的可用模型是 0.6B Q8,其 GGUF 大小为 639MB。我使用我的llm-sentence-transformers插件进行了如下尝试:

llm install llm-sentence-transformers llm sentence-transformers register Qwen/Qwen3-Embedding-0.6B llm embed -m sentence-transformers/Qwen/Qwen3-Embedding-0.6B -c hi | jq length

此输出为 1024,确认 Qwen3 0.6B 产生 1024 长度的嵌入向量。

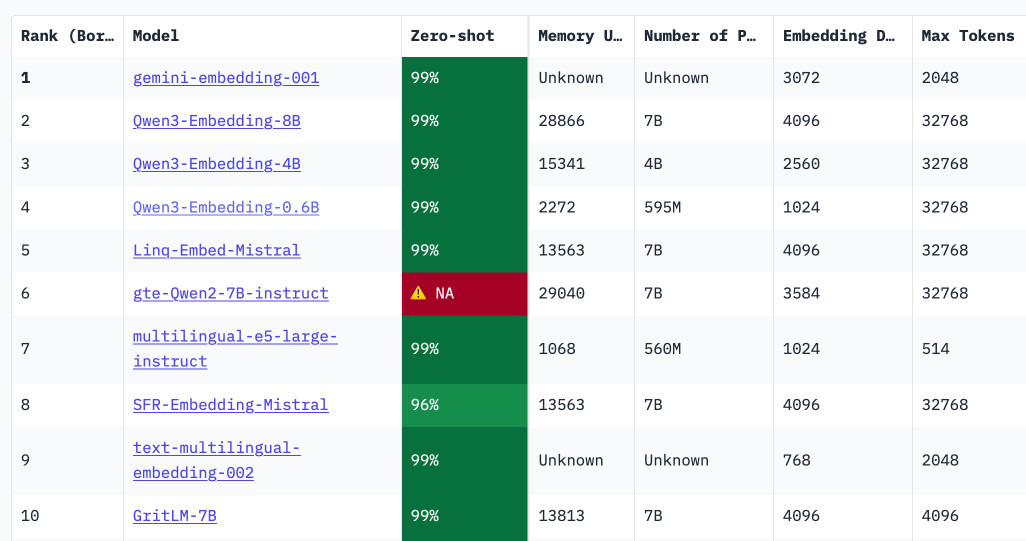

这些新模型是备受推崇的MTEB 排行榜上得分最高的公开重量模型 – 它们获得了 Apache 2.0 许可。

原文: https://simonwillison.net/2025/Jun/8/qwen3-embedding/#atom-everything