Qwen/Qwen3-235B-A22B-Instruct-2507

Qwen 昨天发布了重要的新模型,但没有引起太多关注。

这是他们4 月份发布的 Qwen 3 完整模型系列的后续产品,其中包括 Qwen3-235B-A22B 模型,该模型可以处理推理和非推理提示(通过/no_think切换)。

新的Qwen3-235B-A22B-Instruct-2507放弃了这种机制——它完全是一个非推理模型。看来 Qwen 正在开发新的推理模型。

这个新模型基于 Apache 2 许可,有两种官方尺寸:BF16 模型(在 Hugging Face 上文件大小为 437.91GB)和FP8 变体(220.20GB)。VentureBeat 估计,大模型需要 88GB 显存,而小模型则需要约 30GB 显存。

这些新型号的基准测试结果看起来非常有希望。Qwen 自己的数据显示,它在非思考模式下的几项测试中都击败了 Claude 4 Opus,也表明其性能比之前的 235B-A22B 型号有了显著提升。

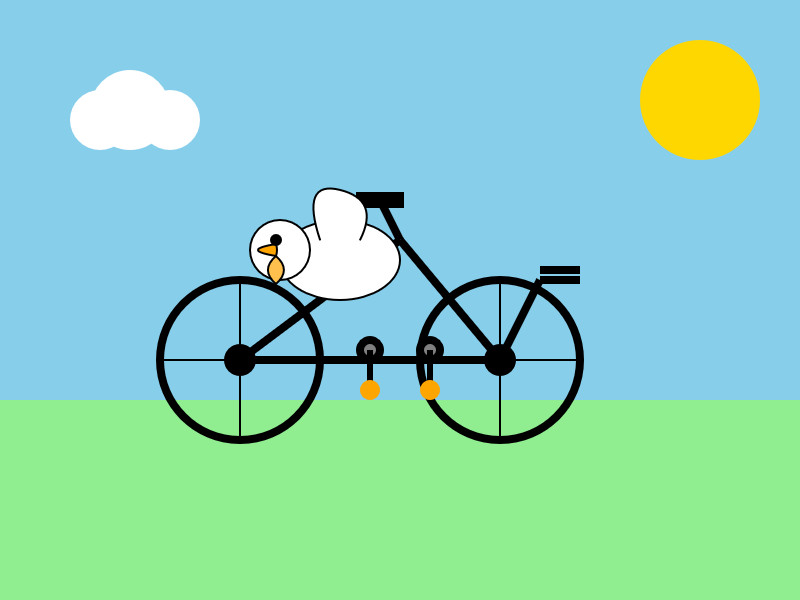

我还没有看到任何独立的基准测试结果。以下是我在 OpenRouter 上使用 qwen3-235b-a22b-07-25:free运行“生成鹈鹕骑自行车的 SVG”的结果:

llm install llm-openrouter llm -m openrouter/qwen/qwen3-235b-a22b-07-25:free \ "Generate an SVG of a pelican riding a bicycle"标签:llm install llm-openrouter llm -m openrouter/qwen/qwen3-235b-a22b-07-25:free \ "Generate an SVG of a pelican riding a bicycle"

人工智能、生成人工智能、法学硕士、法学硕士、 qwen 、鹈鹕骑自行车、法学硕士发布版、 openrouter

原文: https://simonwillison.net/2025/Jul/22/qwen3-235b-a22b-instruct-2507/#atom-everything