OpenAI 今天早上推出了三款新模型:GPT-4.1、GPT-4.1 mini 和 GPT-4.1 nano。目前这些是仅 API 的模型,无法通过 ChatGPT 界面使用(尽管您可以在 OpenAI 的API 游乐场中尝试它们)。所有三个模型都可以处理 1,047,576 个输入令牌和 32,768 个输出令牌,并且所有三个模型都有 2024 年 5 月 31 日的截止日期(他们之前的模型大多是 2023 年 9 月)。

这些模型在编码基准测试中的得分高于 GPT-4o和GPT-4.5,并且在长上下文基准测试中也表现出色。他们还声称在遵循指令方面有所改进——遵循要求的格式、遵守否定指令、对输出进行排序以及遵守说“我不知道”的指令。

我发布了支持新模型的llm-openai插件的新版本。这对于LLM生态系统来说是一个新事物:以前 OpenAI 模型仅在核心中受支持,这意味着我必须发布完整的 LLM 版本来添加对它们的支持。

您可以像这样运行新模型:

llm 安装 llm-openai-plugin -U llm -m openai/gpt-4.1 “生成鹈鹕骑自行车的 SVG ”

其他型号 ID 为openai/gpt-4.1-mini和openai/gpt-4.1-nano 。

这是我从全尺寸 GPT-4.1 得到的骑自行车的鹈鹕:

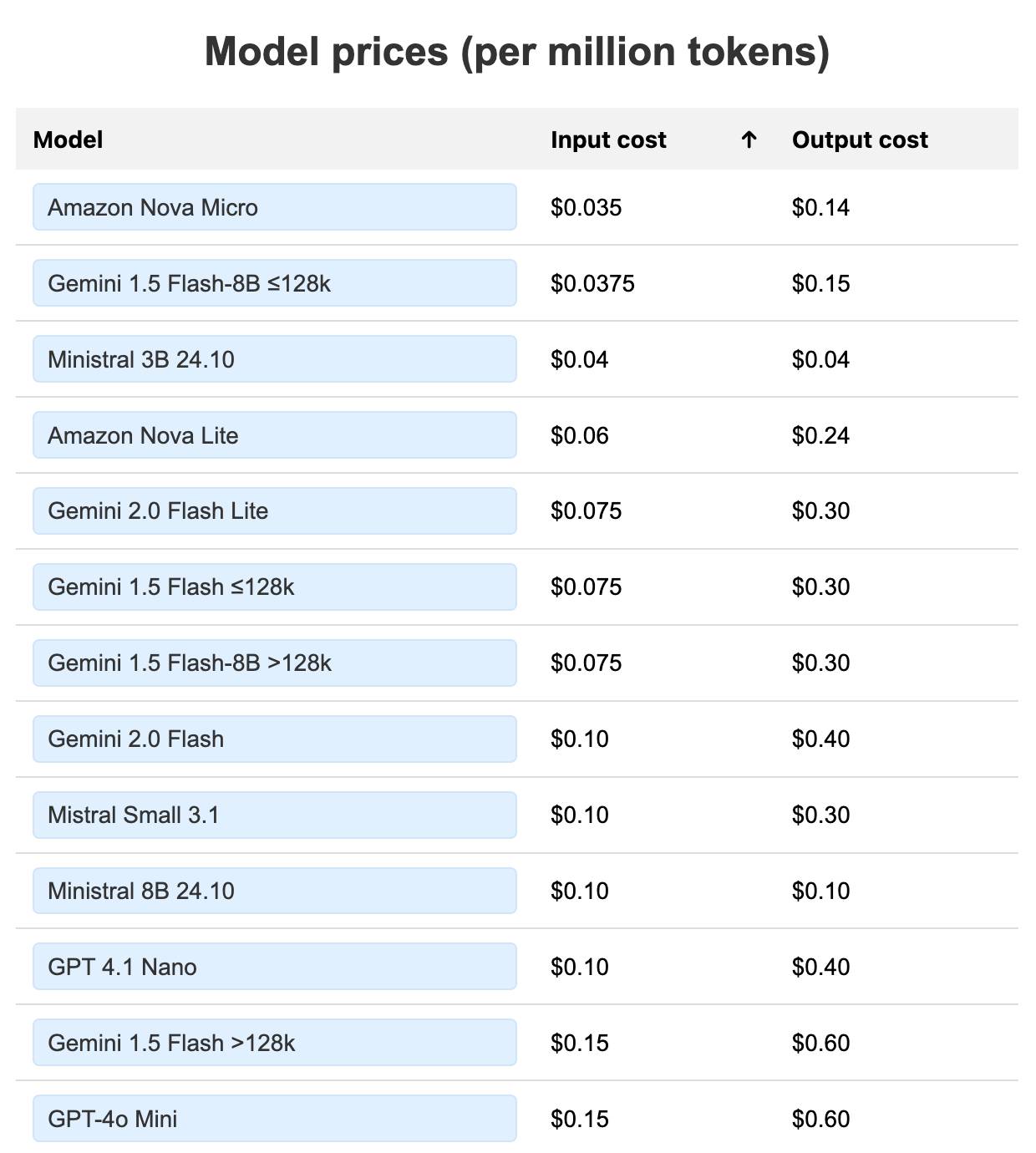

我对GPT-4.1 nano感到特别兴奋,它可以处理多达 100 万个代币的图像和文本输入,并且价格低于任何其他以前的 OpenAI 模型:输入 0.10 美元/百万美元,输出 0.40 美元/百万美元,低于以前最便宜的 OpenAI 模型 GPT-4o-mini(0.15 美元/0.60 美元)。我已经更新了我的法学硕士定价表以包含新模型。

不过,它们总体上并不是最便宜的:Gemini 2.0 Flash Lite 和 Gemini 1.5 Flash 8B、Amazon Nova Lite 和 Nova Micro 以及 Mistral 的 3B、8B 和 Small 3.1 托管型号仍然较便宜。

关于这些新模型的一些总结:

-

100 万个输入令牌上下文确实是一件大事。到目前为止,巨大的代币背景已经成为 Google Gemini 模型全年的主要竞争优势 – 看到其他供应商开始迎头赶上,令人欣慰。我希望 Anthropic 也能做到这一点 – Claude 是第一个达到 200,000 个销量的模型,但出货量还没有超过这个数字(除了仅限于其大型企业合作伙伴的 500,000 个代币模型)。

-

OpenAI 确实强调了该模型的代码性能。他们在公告中提到了Aider 基准。

-

不出所料,GPT-4.5 的出现时间并不长:

我们还将开始在 API 中弃用 GPT-4.5 预览版,因为 GPT-4.1 以更低的成本和延迟在许多关键功能上提供改进或类似的性能。 GPT-4.5 预览版将于三个月后(即 2025 年 7 月 14 日)关闭,以便开发者有时间进行过渡

-

在直播公告中,Michelle Pokrass透露该模型的代号是 Quasar,这是过去两周在 OpenRouter 上预览的隐形模型的名称。

-

OpenAI 分享了一份GPT 4.1 提示指南,其中包括关于长上下文提示的技巧:

特别是在长上下文使用中,指令和上下文的放置会影响性能。如果您的提示中有很长的上下文,最好将说明放在所提供上下文的开头和结尾,因为我们发现这比仅在上面或下面表现更好。如果您只想获得一次说明,那么上面提供的上下文比下面的效果更好。

他们还建议在日志上下文中使用 XML 样式的分隔符而不是 JSON,建议这种格式(包含 XML 无效的未加引号的属性)类似于Anthropic 为 Claude 推荐的格式:

< doc id =1 title = " The Fox " >敏捷的棕色狐狸跳过了懒狗</ doc >

最后有一个详细的部分描述了他们推荐的应用文件差异的方法:“我们在这里开源了一种推荐的差异格式,模型已经在该格式上进行了广泛的训练”。

标签: ai 、 openai 、生成式人工智能、 llms 、 llm 、视觉 llms 、 llm 定价、长上下文、 llm 发布

原文: https://simonwillison.net/2025/Apr/14/gpt-4-1/#atom-everything