GDPR、CCPA 和 HIPAA 等数据隐私法规对训练人工智能系统处理敏感数据(如金融交易、患者健康记录和用户设备日志)提出了挑战。历史数据是“教”人工智能系统识别模式和做出预测的东西,但在不影响个人身份的情况下使用它存在技术障碍。

近年来流行的一种解决方法是联合学习。该技术在不交换数据的情况下跨多个设备或服务器训练一个系统,使协作者能够构建一个通用系统而无需共享数据。英特尔最近与Penn Medicine 合作开发了一个使用联邦学习的脑肿瘤分类系统,而包括诺华和默克在内的一组主要制药公司则建立了一个联邦学习平台来加速药物发现。

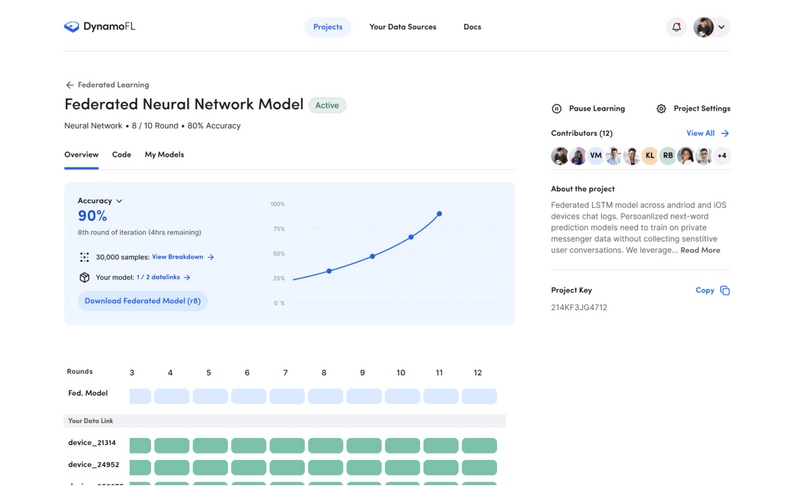

包括英伟达(通过Clara )在内的科技巨头提供联邦学习即服务。但是一家新的初创公司DynamoFL希望通过一个专注于性能的联邦学习平台与现有企业竞争,表面上不牺牲隐私。

“ DynamoFL 由麻省理工学院电气工程和计算机科学系的两位博士、Christian Lau 和我自己创立,他们在过去五年中致力于保护隐私的机器学习和机器学习硬件,”首席执行官 Vaikkunth Mugunthan 在电子邮件采访中告诉 TechCrunch . “在我们收到领先的金融和技术公司的重复工作邀请后,我们发现了一个巨大的联合学习市场,这些公司试图根据 GDPR 和 CCPA 等新兴隐私法规在内部构建联合学习。在此过程中,很明显,这些组织在内部努力支持联邦学习,我们构建了 DynamoFL 来解决市场上的这一差距。”

声称在汽车、物联网和金融领域拥有主要客户的 DynamoFL 正处于其进入市场战略的早期阶段。 (这家初创公司目前有 4 名员工,计划在今年年底前招聘 10 名员工。)但 DynamoFL 一直专注于改进新的 AI 技术以在竞争中脱颖而出,提供可以提高系统性能同时对抗攻击和漏洞的能力。联合学习——比如“成员推理”攻击,可以检测用于训练系统的数据。

图片来源: DynamoFL

“我们的个性化联合学习技术……使[s] 机器学习团队能够微调他们的模型,以提高各个群组的性能。这让高管在部署以前被认为是黑盒解决方案的机器学习模型时更有信心,” Mugunthan 说。 “这 [也] 将我们与 Devron、Rhino Health、 Owkin 、NimbleEdge 和 FedML 等竞争对手区分开来,这些竞争对手正努力应对传统联邦学习的共同挑战。”

DynamoFL 还宣传其平台与其他保护隐私的 AI 点解决方案相比具有成本效益。 Mugunthan断言,由于联邦学习不需要在中央服务器上大量收集数据,DynamoFL 可以降低数据传输和计算成本——例如,允许客户只发送小的增量文件,而不是 PB 级的原始数据。作为一个额外的好处,这可以通过消除在单个服务器上存储大量数据的需要来降低数据泄漏的风险。

“常见的隐私增强技术(如差分隐私和联邦学习)一直存在“隐私与性能”权衡,在模型训练期间使用更强大的隐私保护技术不可避免地会导致模型准确性下降。这一关键的瓶颈挑战阻止了许多机器学习团队采用保护用户隐私所需的隐私保护机器学习技术,同时遵守监管框架,”Mugunthan 说。 “DynamoFL 的个性化联合学习解决方案解决了机器学习采用的关键障碍。”

最近,DynamoFL 完成了小额种子轮融资(415 万美元,估值 3500 万美元),由 Y Combinator、Global Founders Capital 和 Basis Set 参与;这家初创公司是 Y Combinator 2022 年冬季批次的一部分。 Mugunthan 表示,收益将主要用于招聘能够将 DynamoFL 的技术集成到未来用户友好型产品中的产品经理。

“这场大流行凸显了迅速利用各种数据应对新兴医疗危机的重要性。特别是,大流行强调了在危机时期需要使关键的医疗数据更容易获得,同时仍然保护患者隐私,”Mugunthan 继续说道。 “我们已经做好了应对科技放缓的准备。我们目前有三到四年的跑道,技术放缓实际上有助于我们的招聘工作。最大的科技公司正在招聘大多数领先的联邦学习科学家,因此大型科技公司招聘的放缓为我们提供了一个招聘顶级联邦学习和机器学习人才的机会。”

DynamoFL 旨在将保护隐私的 AI 带入更多行业,作者Kyle Wiggers最初发表在TechCrunch上

原文: https://techcrunch.com/2022/09/20/dynamofl-aims-to-bring-privacy-preserving-ai-to-more-industries/