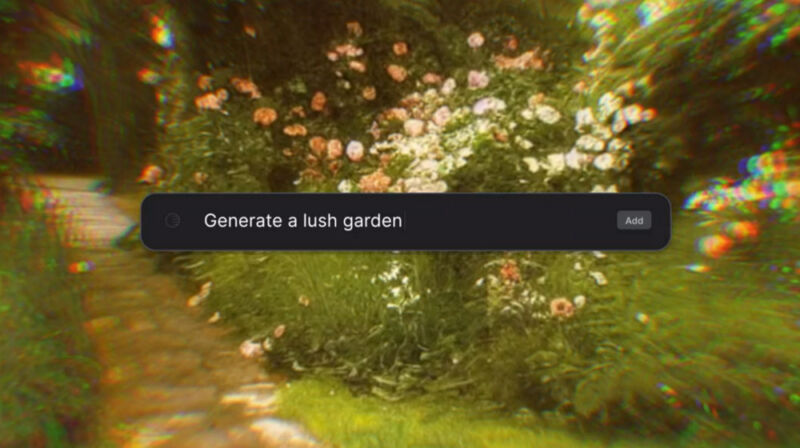

放大/来自 Runway 的“Text to Video”预告片宣传片的剧照,暗示了图像生成功能。 (信用:跑道)

在今天早上发布的一条推文中,人工智能公司 Runway取笑了其基于人工智能的网络视频编辑器的一项新功能,该功能可以根据书面描述编辑视频,通常称为“提示”。一段宣传视频似乎展示了商业视频编辑或生成的早期步骤,呼应了最近的文本到图像合成模型(如稳定扩散)的炒作,但有一些乐观的框架来掩盖当前的限制。

Runway 的“文本到视频”演示卷轴显示了一个文本输入框,允许编辑命令,例如“导入城市街道”(暗示视频剪辑已经存在)或“使其看起来更具电影感”(应用效果)。它描绘了某人键入“移除对象”并使用绘图工具选择街灯然后消失(根据我们的测试,Runway 已经可以使用其“修复”工具执行类似的效果,但结果喜忧参半)。宣传视频还展示了类似于 Stable Diffusion 的静态图像文本到图像生成(请注意,视频没有描述任何这些生成的运动场景),并演示了文本叠加、字符掩蔽(使用其“绿屏”功能,也已经出现在跑道上)等等。

让任何想法成为现实。就写吧。

文字转视频,即将登陆 Runway。

注册抢先体验: https: //t.co/ekldoIshdw pic.twitter.com/DCwXcmRcuK

— 跑道 (@runwayml) 2022 年 9 月 9 日

除了视频生成承诺之外,Runway 的 Text to Video 公告似乎最新颖的是基于文本的命令界面。未来视频编辑器是否愿意使用自然语言提示还有待观察,但演示表明视频制作行业的人们正在积极朝着合成或编辑视频像编写命令一样简单的未来努力。