大家好,

欢迎阅读第560期周日特刊。本周可谓是反应过度的一周。华尔街对6500亿美元的人工智能支出感到恐慌。萨姆·奥特曼和达里奥·阿莫迪互相攻击。

但这正是 Exponential View 的宗旨……我们深入探究推动市场、技术和社会发展的根本力量。

今天,我将剖析投资者在恐慌中犯了哪些错误,哪些模型升级比基准指数所显示的更重要,以及我从与那些不眠不休的经纪人相处中学到了什么(包括揭晓我最喜欢的思考工具……那是我自己开发的)。

市场反应过度。

本周,大型科技公司的总市值蒸发了超过 1 万亿美元(Anthropic 的 Claude Cowork 插件还引发了另一次 2850 亿美元的市值暴跌),我们看到市场对他们并不真正理解的新范式反应过度。

我一直以来都在批评我们现在看到的这种线性投资思维——原因很简单,资本市场并非为人工智能这类通用型指数级增长技术提供资金而建立的。 我之前写过:

对资本市场而言,这种不确定性不仅仅在于谁会在一场定义明确的博弈中胜出,更在于博弈的类型。市场使用的工具假定竞争结构相对稳定,增长大致呈线性,以此来对公司未来三到十年的现金流进行定价。

超大规模数据中心运营商并非盲目投入资源。他们面临的是资源短缺,而非需求不足。微软首席财务官艾米·胡德承认,她不得不在分配给 Azure 客户和微软自家产品之间做出选择。这就是人工智能时代资源稀缺的真实写照。

正如我们在与 Epoch AI 的研究中所示,在推理阶段运行前沿模型可以获得可观的毛利率;模型层面的经济效益是可以实现的。真正昂贵的是无休止的研发循环,每个新模型都会在几个月内贬值。

但市场尚未充分认识到,一旦车型价格突破某个门槛,需求就会出现爆炸式增长。这被称为智能体的“一致性阈值” 。我对此深有体会:我的智能体 Mini Arnold 💪 每天要消耗价值 20-30 美元的代币,一年下来大约 5000 美元。而且我已经用上了成本最低的模型。一旦模型能够稳定地连续工作 10 到 20 个小时完成任务,我就会运行数百个这样的模型。这就是我们几个月内要达到的目标。

所以,当我审视本周的抛售潮时,我看到的是那些尚未体验到人工智能代理将10小时繁琐工作压缩到40分钟这一突破性时刻的投资者。一旦这种认知从早期采用者普及到普通大众,这6500亿美元的抛售就不会显得鲁莽,反而会让人觉得他们投入得不够。

另请参阅,我周五在与……的直播对话中也谈到了这一点。 ,以及我们的:

来自赞助商的信息

在 Framer 上,初创公司发展更快

第一印象至关重要。借助Framer ,初创公司创始人可以在数小时内推出美观且可直接上线的网站——无需开发团队,轻松便捷。

新加入 Framer 的种子轮和天使轮初创公司将获得:

-

免费使用一年:购买 Framer Pro 一年,立省 360 美元,早期创业公司可免费使用。

-

无需编写代码,无需等待:无需招聘技术人员,即可在数小时内(而不是数周内)推出精美的网站。

-

专为发展而打造:利用内容管理系统、分析和人工智能本地化功能,将您的网站从最小可行产品 (MVP) 扩展到完整产品。

-

加入 YC 支持的创始人行列:数百家顶级初创公司已经在 Framer 上进行开发。

如需赞助第二季度的 Exponential View,请点击此处联系我们。

当你观看超级碗的时候……

本周,Anthropologie 和 OpenAI 展开了全面较量。首先,我想谈谈我对模型升级的看法——然后,再解释一下超级碗玩笑的真正含义。

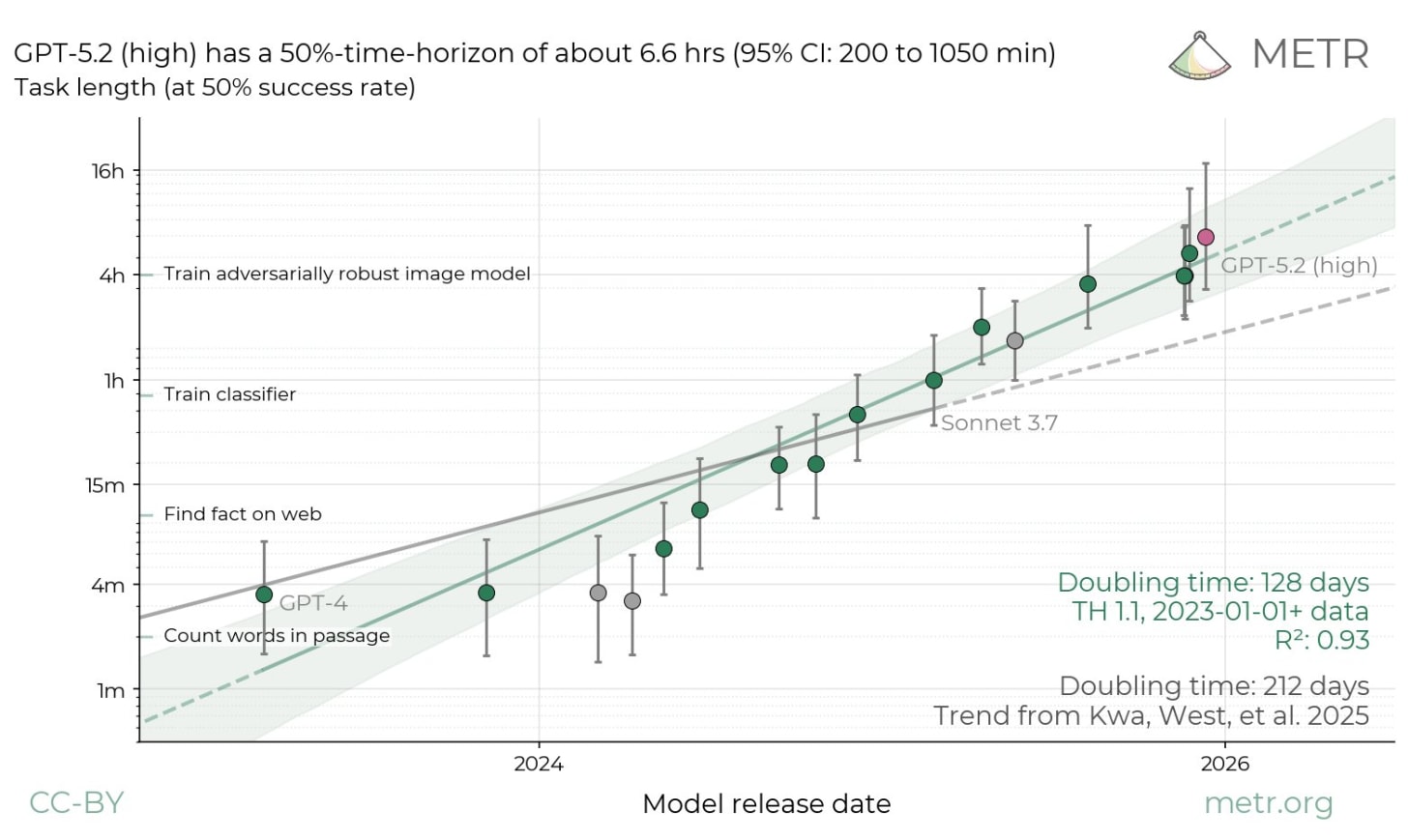

本周我们迎来了两个版本号为+0.1的升级: Claude Opus 4.6和GPT-5.3-Codex 。十进制升级通常意味着改进幅度有限,在很多方面也确实如此。在规划能力、上下文感知能力和错误率等方面的基准测试均有所提升——尽管有些提升幅度不大。但人工智能目前正处于一个阶段,在这个阶段,真正具有经济意义的变量只有一个:人工智能能够完成任务的时间以及自主程度。这两个版本号为+0.1的模型都展现出了指数级的增长。

Opus 4.6 和 Opus 5.3-Codex在 GPT 5.2(注意,不是新的 Codex)上的基准测试更新显示,模型性能几乎翻了一番。Opus 4.6 和 5.3-Codex 的主要问题是:它们的性能能否持续更长时间?

Anthropic 公司的 Nicholas Carlini 让 16 个 Claude 智能体从零开始构建一个 C 编译器,然后基本上就放手不管了¹ 。两周后,花费了 2 万美元的 API 费用,这些智能体编写了 10 万行 Rust 代码,生成了一个可以在 x86、ARM 和 RISC-V 架构上构建 Linux 内核的编译器。这可不是玩具² 。

能够构建 Linux 的 AC 编译器确实是一个棘手的工程难题。Carlini 曾用早期的 Opus 型号尝试过同样的实验。几个月前发布的 Opus 4.5 可以通过测试套件,但在实际项目中却表现不佳。再往前几代产品几乎无法生成功能齐全的编译器。Opus 4.6 完成了一项为期两周的工程任务。自主执行能力的每一次提升,都意味着实际应用效果的显著提升。

好了,现在让我们来看看超级碗……

就连萨姆·奥特曼(Sam Altman)也被 Anthropic 的超级碗广告逗乐了,这些广告将 Claude 定位为 ChatGPT 的无广告替代品;随后他进行了反击:

Anthropologie 为富裕人群提供昂贵的产品。……我们致力于提供免费获取途径,因为我们相信获取途径能够创造自主权。

山姆的评论围绕着一个与商业互联网一样古老的二元对立展开:你如何为服务付费——用现金还是用自身?在过去的十多年里,价格是我们的注意力。正如我们在一年前的EV#509中强调的那样,人工智能产品的使用将使经济重心从注意力转向意图:

逻辑逻辑模型和预测性人工智能可以超越注意力范畴,塑造我们的意图——引导我们想要做什么或计划做什么,这被一些人称为“意图经济”。人工智能系统可以推断和影响用户的动机,从看似无害的互动中获取意图信号,并大规模地个性化说服性内容。

安全专家布鲁斯·施奈尔认为,当人工智能像人一样说话时,我们就会像信任人一样信任它。我们会把它当作朋友,但实际上它只是企业产品,是为了服务于公司的目标,而不是我们个人的目标。这种健谈且“乐于助人”的界面营造了一种亲密感,而这恰恰是我们最应该保持警惕的地方。这种感觉与现实之间的差距,正是他和许多其他人所担忧的。

微软人工智能首席执行官穆斯塔法·苏莱曼在我们的对话中进一步阐述了他的观点。他认为人工智能的情感智能确实很有用,它能让我们更冷静、更高效、更愿意授权。但他划清了一条底线:模型绝不能模拟痛苦。他说,那样做“会破坏我们的同理心”。市场动态可能会直接推动我们走向这条底线,因为那些模型最能体现人性的公司将赢得最多的用户参与。

-

另请参阅:谷歌DeepMind的研究人员区分了人工智能中的理性说服和有害操纵。前者基于诉诸理性,运用事实、理由和可靠证据;后者则通过隐瞒事实、歪曲事实或施加压力来欺骗他人。

与新生生命共同生活

我一直怀疑,与强大的人工智能,尤其是智能体共同生活,会引发我们祖先从未经历过的人类体验。去年四月,我曾撰文探讨时间压缩作为与人工智能共事所带来的新的情感挑战:

借助全新的AI驱动工作流程,我按照一系列模块化提示和自动化脚本完成了各项步骤。系统解析、筛选并整理了输入内容,几乎无需人工干预。最后稍作编辑,15分钟就完成了。

然而,我并没有感到胜利的喜悦,反而感到……不安。我是不是漏掉了什么?是不是跳过了关键步骤?结果是不是太稀薄了?

并非如此。工作完成了,而且做得很好。但我还没能在情感上适应新的节奏。

我感同身受有人把智能体人工智能称为“吸血鬼”,多个智能体持续运行,需要人类的监督和输入,消耗大量精力,让人难以恢复正常作息,甚至影响睡眠。在我搭建多智能体系统的最初几天,我发现自己凌晨四点就得起床检查智能体,排除故障,并在多个项目之间切换,直到达到精力极限才能回去睡觉。

我们仍在探索智能体真正发挥作用的领域,而一个关键问题是同时使用多少个智能体。多智能体系统在工作可以拆分成并行流程时表现出色,但在处理顺序紧密的任务时则会失效。

对于高风险工作——例如投资尽职调查、棘手分析或发散性探索——我现在会使用 Clade,这是一个我构建的多智能体系统,其中人工智能会相互辩论,直到出现更优答案³ 。以下是它的工作原理……