周一,面对日益激烈的竞争,OpenAI 首席执行官 Sam Altman 宣布进入“红色警戒”状态。

最大的威胁来自谷歌;谷歌旗下聊天机器人Gemini的月活跃用户从7月份的4.5亿增长到11月份的6.5亿(ChatGPT在10月份的周活跃用户达到8亿)。与此同时,《华尔街日报》 报道称,“OpenAI也面临着来自Anthropic的压力,后者在企业客户中越来越受欢迎。”

两周前,谷歌发布了Gemini 3模型,在多项基准测试中创下新纪录,这无疑加大了对OpenAI的压力。紧接着,Anthropic Games发布了Claude Opus 4.5,并在部分相同的基准测试中取得了更高的分数。

过去两周,我一直在思考如何以最佳方式报道这些新产品。以前,我会对每款新机型进行一系列定制的基准测试,然后撰写评测文章。但最近的机型已经足够优秀,可以轻松解决大多数此类问题。它们在一些简单的任务上仍然存在不足(例如在模拟时钟上显示时间),但我担心这些例子越来越无法代表实际使用情况。

未来,我希望能够更深入地探讨谷歌和Anthropic这两款新模型的性能表现。但就目前而言,我想先对这些模型进行一些定性分析。更确切地说,我想重点介绍两点,它们分别体现了谷歌和Anthropic截然不同的企业文化——正是这些文化差异导致它们在模型构建方面采取了截然不同的方法。

谷歌的卓越工程技术

上周,《Semianalysis》通讯发表了一篇深度分析文章,探讨了谷歌的张量处理器单元(TPU)——英伟达GPU的替代方案——所取得的成功。“Gemini 3是世界上最好的模型之一,它完全是在TPU上训练的,”《Semianalysis》的作者写道。值得注意的是,Claude Opus 4.5也是在TPU上训练的。

谷歌十年来一直将TPU用于自身的AI需求。但最近,谷歌开始认真地向其他公司出售TPU。Semianalysis团队认为,谷歌是“英伟达在商用芯片领域最新、最具威胁的挑战者”。

10月份,Anthropic签署了一项协议,将使用多达100万个TPU。据Semianalysis报道,除了从谷歌购买云服务外,“Anthropic还将在其自有设施中部署TPU,这将使谷歌能够直接与英伟达展开竞争。”

近几代的TPU芯片性能尚可,但Semianalysis认为谷歌真正的优势在于其整体系统架构。现代人工智能训练需要数千个芯片连接在一起以实现快速通信。谷歌设计的机架和网络系统能够最大限度地发挥每个芯片的性能。

这是更广泛原则的一个例子:谷歌本质上是一家以工程为导向的公司,它将大型语言模型视为一个工程问题来处理。工程师们努力以尽可能低的成本训练尽可能大的模型。

例如,Gemini 2.5 Flash-Lite 一百万个输入令牌只需 10 美分。Anthropic 最便宜的型号 Claude Haiku 4.5 的价格是它的 10 倍。谷歌也是第一家发布百万令牌上下文窗口 LLM 的公司。

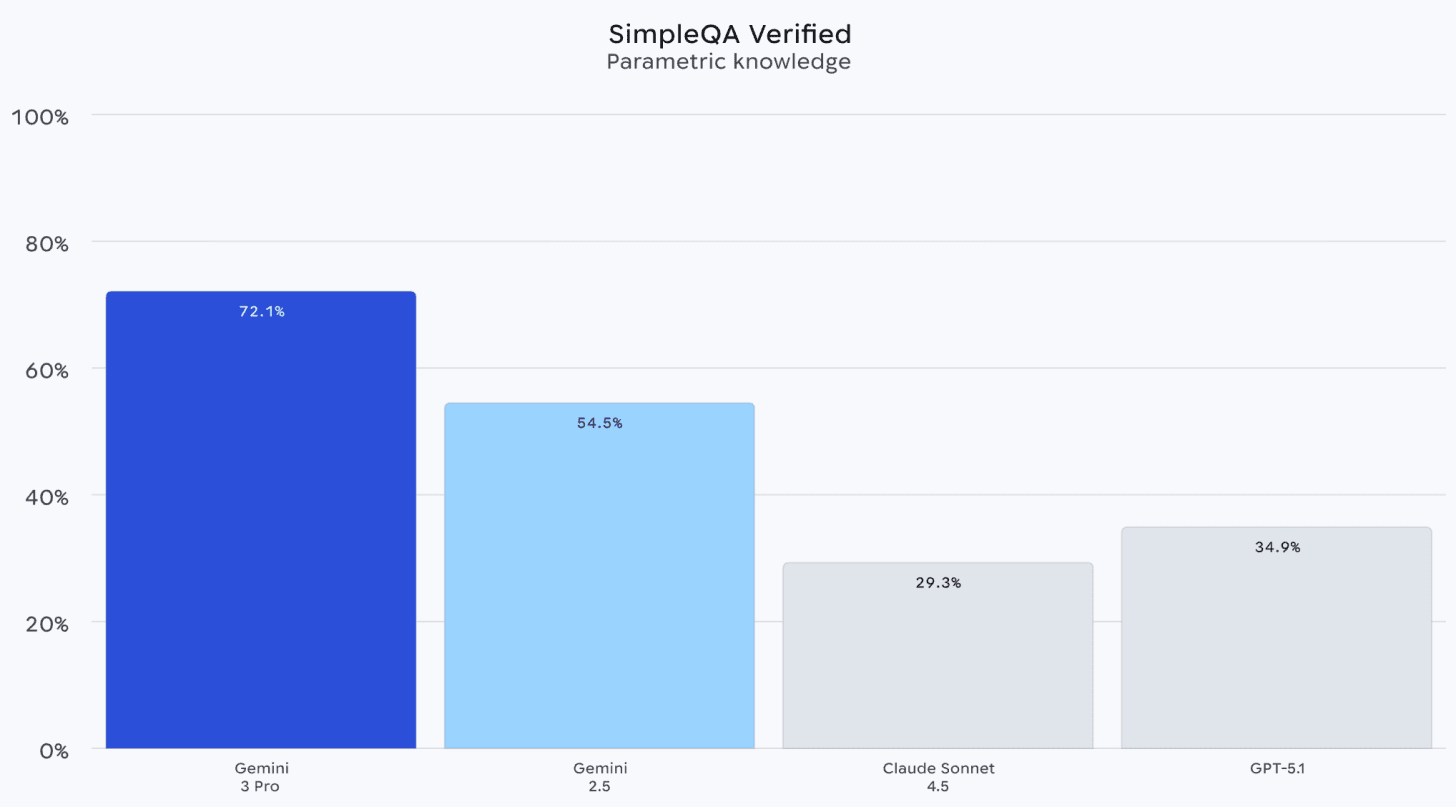

谷歌的工程实力在预训练方面也得到了充分体现。谷歌发布了这张图表,显示 Gemini 3 在 SimpleQA 测试中遥遥领先于其他模型。SimpleQA 是一项基准测试,用于衡量模型回忆晦涩事实的能力。

正如一位眼光敏锐的Reddit评论者所指出的那样,这可能反映了谷歌大规模部署计算硬件的能力。

jakegh 写道:“我的理解是,Gemini 3 Pro 在 SimpleQA 测试中取得的进步表明,它是一个规模庞大的模型,绝对庞大,拥有大量的参数知识。谷歌使用自己的 TPU 硬件不仅进行推理,还进行训练,所以他们有能力做到这一点。”

Gemini 3延续了谷歌打造性能可靠、价格亲民机型的传统。公众对这款新机型的反响普遍积极;该机型在实际应用中的表现似乎与基准测试结果一样出色。

新模型似乎缺乏个性,但这或许无关紧要。数十亿人已经在使用谷歌产品,因此,谷歌或许只需将像 Gemini 3 这样优秀但并非惊艳的模型添加到搜索、Gmail 和 Google Workspace 套件等产品中,就能赢得人工智能竞赛。

人本主义:对模型进行深入思考

上周发布的 Claude Opus 4.5 也获得了积极的反响,但氛围却有所不同。

原文: https://www.understandingai.org/p/google-and-anthropic-approach-llms