尽管 [Vitor Fróis] 解释线性回归是因为它与机器学习相关,但这篇文章以及该主题实际上在我们使用电子和计算机所做的许多事情中都有广泛的应用。它是使用自变量预测因变量的一种方法,最简单的形式是基于一条直线。

您可能还记得在学校里,直线可以用:y=mx+b 来描述。这里,m 是直线的斜率,b 是 y 轴截距。另一种思考方式是,m 是线上升的速度(或下降的速度,如果 m 为负),b 是线在 x=0 处“开始”的位置。

[Vitor] 首先举了一个很好的例子:房价(因变量)和面积(自变量)。正如您所猜测的,较大的房屋往往比较小的房屋售价更高。但这并不是一个精确的公式,因为房屋售价升高或降低的原因有很多。如果你绘制它,你不会得到一条漂亮的线;你会得到一团点,这些点围绕着一些假想线聚集在一起。

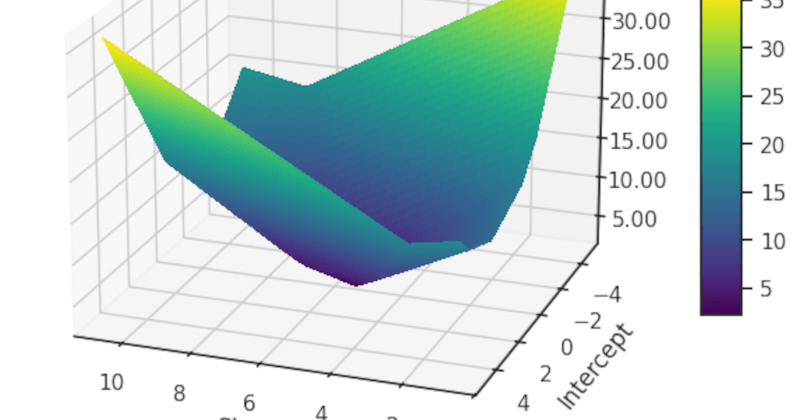

有一些数学方法可以计算出您应该想象什么线,但您通常也可以目视它。真正的技巧是评估这条假想线的质量。

为此,您需要一个误差测量。如果您不太了解,您可能会认为用绝对值来表达误差是最好的。你知道,“这是 10 折”之类的。但是,正如 [Vitor] 所解释的,执行此操作的标准方法是使用平方误差项 R 2 。为什么?阅读帖子并找出答案。

对于电子产品,线性回归有许多应用,包括解释传感器数据。例如,您还可以使用它来概括一批未知组件。想象一批在不同频率下具有不同 Beta 值的晶体管。线性回归将帮助您预测 Beta,误差项将告诉您是否值得使用该预测。或者,也许您只是想煮一杯完美的咖啡。

原文: https://hackaday.com/2025/05/08/understanding-linear-regression/