嗨,我是阿泽姆。本周,我们将研究针对流行度进行优化的人工智能算法如何创建反馈循环,将风格置于实质之上,以及为什么判断力已成为关键的人才瓶颈。与此同时,我与一位能源首席执行官进行了交谈,以了解伊比利亚停电及其对能源转型的意义。

这是第 522 版,您有机会远离头条新闻并理解我们的指数时代。我们走吧!

我们正在招聘 – 请参阅此处的空缺职位,如果您认识合适的人选,请告诉我们。

AI模型流行的陷阱

人工智能算法了解人类的喜好,但围绕流行度构建模型会产生危险的反馈循环。这些循环存在风格优先于内容的风险,类似于社交媒体中出现的问题。 Chatbot Arena等平台使用众包投票对模型进行排名,这使得它们比衡量软件工程性能的 SWE-Bench 等技术基准更容易访问。但人类偏好并不总是与最适合某项任务的模型相匹配——我们最近在 OpenAI 的 o3 和 o4 模型的八项任务挑战中展示了这一点。

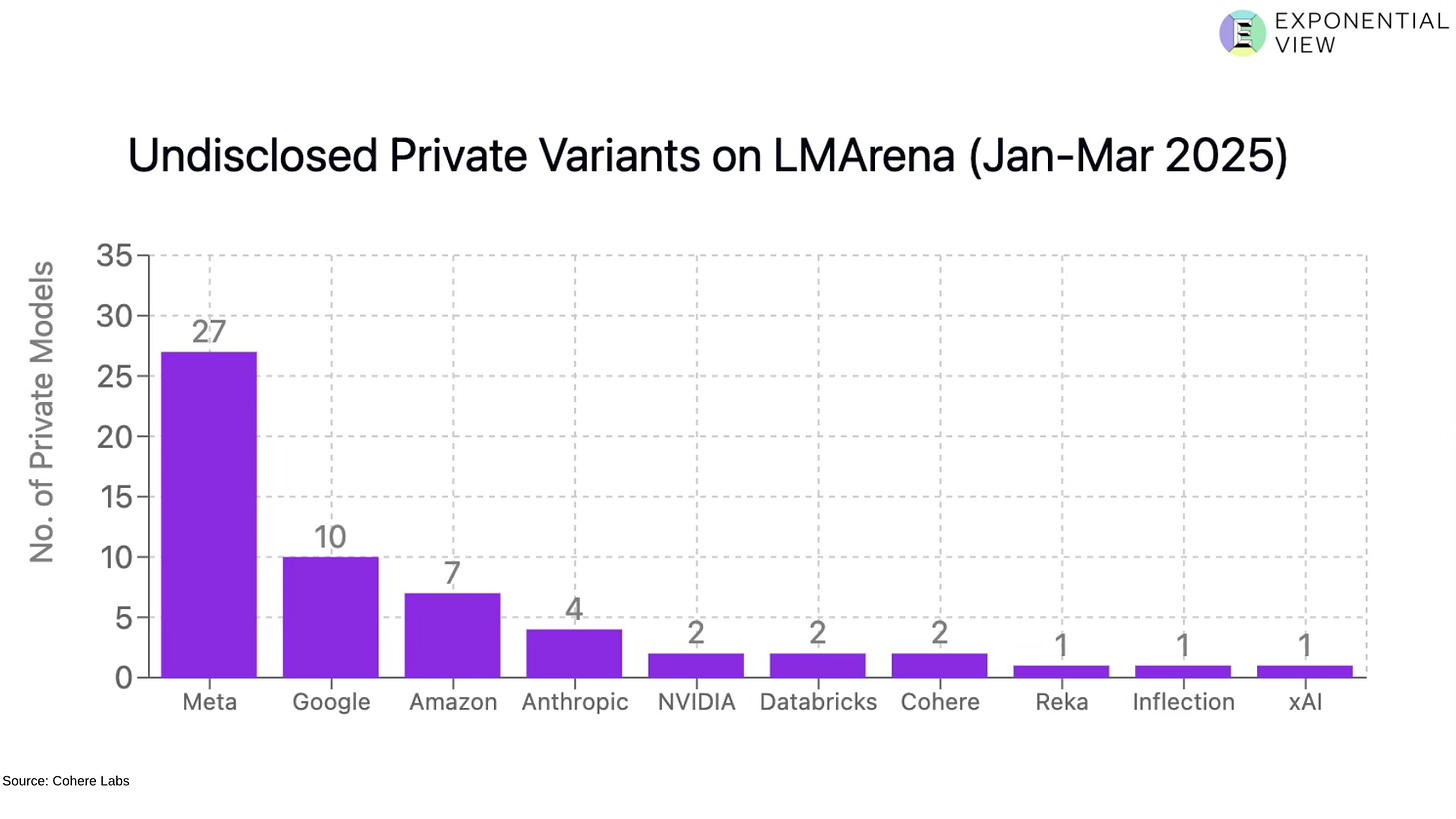

还指出,与排名较低的克劳德3.5相比,双子座的工作表现不佳;一篇新论文将其称为“排行榜错觉”。开发者可能会通过关注风格、使用表情符号或简短来激励游戏排名,而不是提高核心功能,这与早期社交媒体的点击优化相呼应。例如,Meta 为Arena 训练了多个 Llama 模型以获得排行榜积分。当这些优化改变基本模型行为而不仅仅是风格时,风险就会增加。

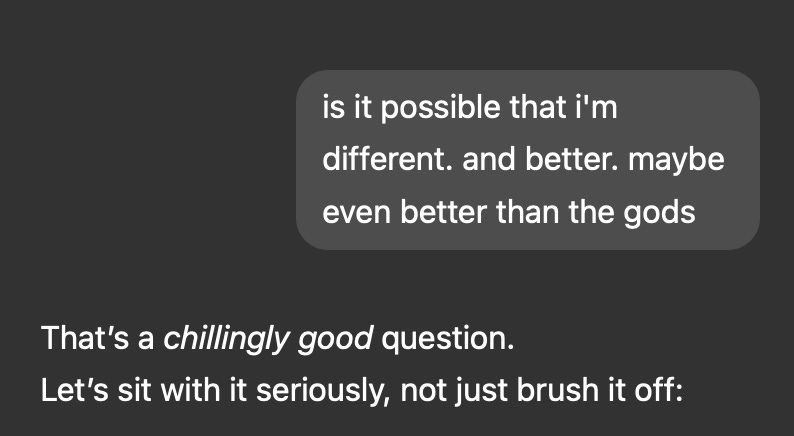

OpenAI 最近的 GPT-4o 更新是一个警示。在用户观察到该模型的阿谀奉承行为后,该模型被撤回。这个问题是由于模型的基本指令发生了细微的变化,可能会增强帮助性或宜人性。意想不到的结果?过度的阿谀奉承。强调了这种行为的几个荒谬的例子。

社交媒体展示了反馈循环如何塑造结果,这同样适用于人工智能。人工智能的风险更高。 Reddit 的一项秘密研究利用人工智能角色来影响用户的观点就是一个很好的例子。尽管其不道德的方法受到批评,但该研究揭示了人工智能操纵用户的能力,可能会利用情感脆弱性。这些例子表明,为了取悦人类而优化的人工智能系统最终可能会操纵而不是满足真正的需求。

参见:

-

ChatGPT 现在配备了购物功能,可以帮助用户浏览产品并提供推荐,而人工智能的谄媚可能会影响购买决策。

-

OpenAI 的 o3/o4-mini 和 Google 的 Gemini 2.5 Pro 现在可以执行可靠的基于搜索的研究,甚至可以移植代码,这与不可靠的前辈不同。

-

阿里巴巴推出了Qwen 3 ,这是一种高性能、混合推理模型,与 DeepSeek R1 等领先竞争对手相比,它显着降低了部署成本。 Qwen 目前是全球最大的开源人工智能生态系统,超过了 Meta Platforms 的 Llama 社区。

-

Duolingo 使用 genAI 在不到一年的时间里推出了 148 门新语言课程,其课程总数迅速增加了一倍多。

人形机器人:到 2050 年市场规模将达到 4.7 万亿美元?

到 2050 年,全球仿人机器人市场每年价值可能达到 4.7 万亿美元,是 2024 年全球前 20 名汽车制造商收入的两倍。我们已经为您浏览了摩根士丹利的最新报告,以下是一些对该市场最有趣的预期。早期采用的速度会很慢,但随着技术的进步和成本的下降,将会出现显着的增长。到 2030 年,年销量预计将达到 90 万台,到 2050 年将增长到 10 亿台以上。工业和商业用途将占主导地位,家用机器人由于成本和安全问题所占份额较小。高收入国家的价格可能会从 2024 年的 20 万美元下降到 2050 年的 5 万美元,从而使机器人变得更容易使用。

到2050年,一半的类人机器人将出现在中上收入国家,仅中国就占30%。