多年来,研究人员一直在尝试构建人工突触,以期接近人类大脑无与伦比的计算性能。现在,一种新方法已成功设计出比生物同类产品小 1000 倍、速度快 10000 倍的产品。

尽管深度学习在过去十年中取得了巨大的成功,但这种受大脑启发的人工智能方法面临的挑战是,它运行在与真实大脑几乎没有相似之处的硬件上。这就是为什么只有三磅重的人脑可以使用与灯泡相同的电量在几秒钟内完成新任务,而训练最大的神经网络需要数周、兆瓦时的电力和机架专用处理器。

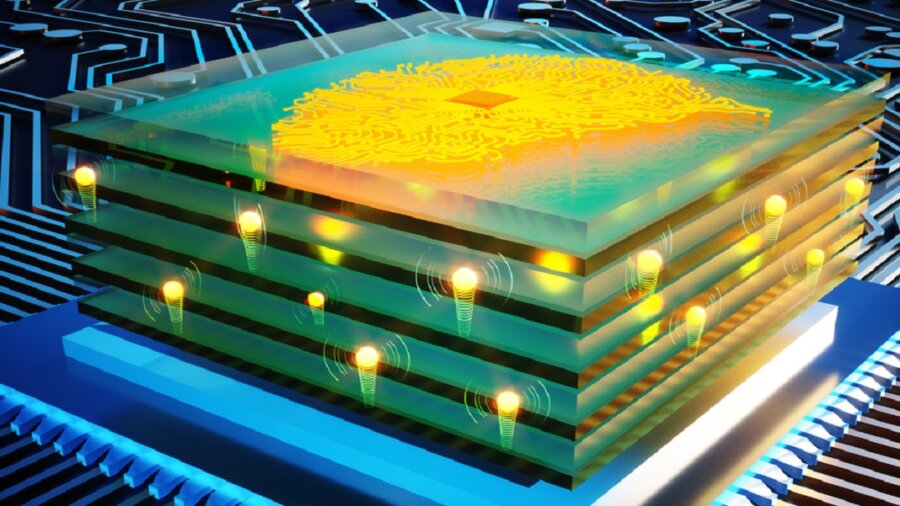

这促使人们对重新设计运行 AI 的底层硬件的努力越来越感兴趣。这个想法是,通过构建其组件更像自然神经元和突触的计算机芯片,我们可能能够接近人类大脑的极端空间和能量效率。希望这些所谓的“神经形态”处理器比今天的计算机芯片更适合运行人工智能。

现在,麻省理工学院的研究人员表明,一种不寻常的人工突触设计模仿大脑对周围穿梭离子的依赖,实际上可以显着优于生物突触。关键的突破是找到了一种能够承受极端电场的材料,这极大地提高了离子的移动速度。

“速度肯定令人惊讶,”领导这项研究的 Murat Onen 在新闻稿中说。 “通常情况下,我们不会在设备上应用如此极端的场,以免将它们变成灰烬。但取而代之的是,质子(相当于氢离子)最终以极快的速度穿过设备堆栈,比我们以前的速度快了一百万倍。”

虽然神经形态工程有多种方法,但最有前途的方法之一是模拟计算。这旨在设计可以利用其内部物理来处理信息的组件,这比执行像传统芯片那样的复杂逻辑操作要高效和直接得多。

到目前为止,许多研究都集中在设计“ 忆阻器”——根据之前流过设备的电荷量来控制电流流动的电子元件。这模仿了生物神经元之间的连接根据它们通信的频率增加或减少强度的方式,这意味着这些设备原则上可用于创建具有与生物神经网络相似特性的网络。

也许不足为奇的是,这些设备通常是使用内存技术构建的。但在《科学》杂志的一篇新论文中,麻省理工学院的研究人员认为,针对长期信息存储优化的组件实际上不适合执行持续调整人工神经网络中连接强度所需的常规状态转换。这是因为确保长保留时间的物理特性通常不能与允许高速切换的物理特性相辅相成。

这就是为什么研究人员转而设计了一种组件,其电导率通过质子插入或移除到由磷硅玻璃 (PSG) 制成的通道中来调节。在一定程度上,这模仿了生物突触的行为,它使用离子通过两个神经元之间的间隙传输信号。

然而,这就是相似之处结束的地方。该设备具有两个终端,本质上是突触的输入和输出。第三个端子用于施加电场,根据电场的方向刺激质子从储存器移动到 PSG 通道中,反之亦然。通道中更多的质子会增加其阻力。

研究人员早在 2020 年就提出了这种通用设计,但他们早期的设备使用的材料与芯片设计工艺不兼容。但更重要的是,切换到 PSG 极大地提高了他们设备的切换速度。这是因为其结构中的纳米级孔隙使质子能够非常快速地穿过材料,还因为它可以承受非常强的电场脉冲而不会降解。

更强大的电场为质子提供了巨大的速度提升,并且是该设备超越生物突触能力的关键。在大脑中,电场必须保持相对较弱,因为任何超过 1.23 伏 (V) 的电压都会导致构成细胞主体的水分解成氢气和氧气。这在很大程度上就是为什么神经过程以毫秒为单位发生的原因。

相比之下,麻省理工学院团队的设备能够以 5 纳秒短的脉冲在高达 10 伏的电压下运行。这使得人工突触的运行速度比其生物突触快 10,000 倍。最重要的是,这些设备只有纳米宽,比生物突触小 1000 倍。

专家告诉《新科学家》,与大多数神经元模型中的两个相反,该设备的三端设置可能会使某些类型的神经网络难以运行。在扩大技术规模时,必须使用氢气引入质子这一事实也带来了挑战。

从单个人工突触到能够进行严肃信息处理的大型网络还有很长的路要走。但组件的非凡速度和微小尺寸表明,这是寻找可以匹配甚至超过人脑能力的新硬件的一个有希望的方向。