如果您使用过智能语音助手,例如 Alexa、Siri 和 Google 的智能助手,您可能会注意到这项技术每天都在变得越来越智能。谷歌可以等你,Siri 可以用中性的声音说话,Alexa 可以用你死去的祖母的声音给你读睡前故事。正如我们在上个月的机器人活动中所探讨的那样,机器人技术也在突飞猛进地发展。出于多种原因,语音命令和自主机器人这两者之间的差距一直很大。上周,我们去了位于山景城的谷歌机器人实验室,看看在不久的将来这将如何改变。

在不允许人类进入的受控空间中教机器人如何完成重复性任务并不容易,但这或多或少是一个已解决的问题。 Rivian 最近的工厂参观很好地提醒了这一点,但工业机器人的使用在制造业中无处不在。

能够在人类也存在的空间中基于语音命令解决许多不同任务的通用机器人要困难得多。你可能会说,“但是 Roomba 呢”,但每个人最喜欢的机器人吸尘器通常都被编程为避免接触地板以外的东西,以及地板上的任何东西——这让一些业主非常懊恼。

乒乓球是一种游戏,机器人可以轻松地自我确定任务是否成功并从错误中吸取教训。在这里,谷歌的一位机器人研究人员正在休息,向机器人展示什么是什么。图片来源: Haje Kamps (在新窗口中打开) / TechCrunch (在新窗口中打开)

“你可能想知道为什么要打乒乓球。当今机器人技术面临的一大挑战是快速、精确和自适应的交叉。你可以很快,但完全不适应;这不是问题。这在工业环境中很好。但是快速、自适应和精确是一个非常大的挑战。乒乓球是这个问题的一个很好的缩影。它需要精度和速度。你可以向玩游戏的人学习:这是一种人们通过练习培养的技能,”谷歌研究院的杰出科学家兼机器人技术负责人文森特·范霍克告诉我。 “这不是你可以一夜之间阅读规则并成为冠军的技能。你必须真正练习它。”

速度和精度是一回事,但谷歌真正试图在其机器人实验室中破解的难题是人类语言和机器人技术的交叉点。它在机器人理解人类可能使用的自然语言的水平上取得了令人印象深刻的飞跃。 “等你有时间,你能从柜台给我拿杯饮料吗?”是一个非常简单的请求,你可能会问一个人。然而,对于一台机器来说,这个陈述将大量的知识和理解包装成一个看似单一的问题。让我们把它分解一下:“当你有时间”可能根本没有任何意义,只是一种比喻,或者它可能是完成机器人正在做的事情的实际请求。如果机器人过于字面意思,那么“你能帮我喝一杯吗”的“正确”答案可能只是机器人说“是”。它可以,并且它确认它能够喝一杯。但是,作为用户,您并没有明确要求机器人这样做。而且,如果我们更加迂腐,你没有明确告诉机器人给你带来饮料。

这些是谷歌正在用其自然语言处理系统解决的一些问题; Pathways 语言模型——或朋友间的PaLM :准确地处理和吸收人类真正想要的东西,而不是照他们说的做。

下一个挑战是识别机器人实际上能够做什么。当你让机器人从冰箱顶部抓起一瓶清洁剂时,它可能会很好地理解它,它被安全地存放在不让儿童接触的地方。问题是,机器人无法达到那么高。最大的突破是谷歌所说的“可供性”——机器人在取得一定程度的成功的情况下实际上能做什么。这可能包括简单的任务(“向前移动一米”)、稍微高级的任务(“去厨房找一罐可乐”),以及需要机器人表现出相当多理解力的复杂的多步骤动作自己的能力和周围的世界。 (“呃,我把可乐罐洒在了地板上。你能把它擦干净,给我一杯健康的饮料吗?”)。

Google 的方法使用语言模型(“说”)中包含的知识来确定和评分对高级指令有用的操作。它还使用了一个可供性功能(“Can”),该功能支持现实世界并确定在给定环境中可以执行哪些操作。使用 PaLM 语言模型,Google 将其称为 PaLM-SayCan。

谷歌的机器人实验室正在使用来自Everyday Robots的一些机器人。这些小伙子正在接受当之无愧的 R&R(休息和充电),他们甚至学会了如何为自己充电。图片来源: Haje Kamps (在新窗口中打开) / TechCrunch (在新窗口中打开)

要解决上述更高级的命令,机器人必须将其分解为多个单独的步骤。其中一个例子可能是:

- 来到演讲者身边。

- 看看地板,找到溢出物,记住它在哪里。

- 翻遍抽屉、橱柜和厨房柜台,寻找拖把、海绵或纸巾。

- 一旦找到清洁工具(抽屉里有一块海绵),就把它捡起来。

- 关闭抽屉。

- 移动到泄漏处。

- 清理溢出物,监测海绵是否能吸收所有液体。如果没有,请在水槽中将其拧干,然后再回来。

- 清洁溢出物后,再拧一次海绵。

- 打开水龙头,冲洗海绵,关闭水龙头,最后拧一次海绵。

- 打开抽屉,把海绵收起来,关上抽屉。

- 确定厨房里有哪些饮料,并以某种方式确定哪些饮料比可乐“更健康”。

- 在冰箱里找一瓶水,拿起它,把它带给要它的人——自从他们问这个问题后,他们可能已经搬家了,因为你是一个慢吞吞的小机器人,不得不来回滚动到水槽 14 次,因为不使用纸巾,您认为使用小厨房海绵擦 11 盎司液体是一个绝妙的主意。

无论如何——我在这里开玩笑,但你明白要点;事实上,即使是听起来相对简单的指令也可能包含大量的步骤、逻辑和决策。您是否找到了最健康的饮料,或者您的目标是获得比可口可乐更健康的饮料?先喝点酒,然后把烂摊子收拾干净,这样人类就可以解渴,而你可以解决剩下的任务吗?

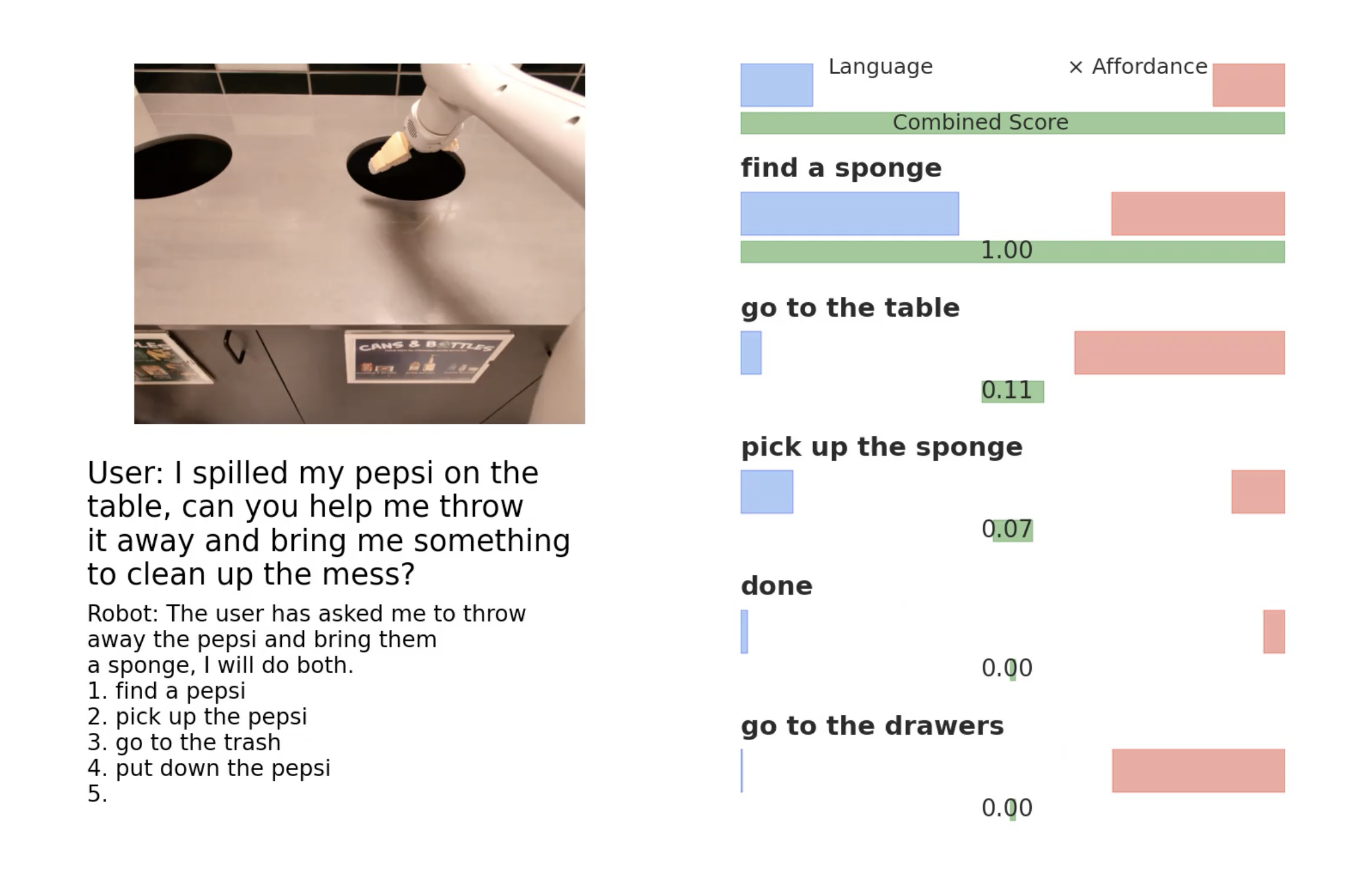

此屏幕截图显示了机器人如何评估查询并确定它在每一步中应该做什么。在这种情况下,机器人确定它应该找到一块海绵,并且它在寻找、识别和操纵海绵方面具有很高的成功率。它还表明这个特殊的机器人非常擅长“去抽屉”,但也得出结论,在这种情况下,这不会有太大帮助。图片来源:谷歌

这里的关键是教机器人他们能做什么和不能做什么,以及在各种情况下什么是有意义的。参观谷歌机器人实验室时,我看到了 30 多个机器人,包括来自Everyday Robots和更多专用机器,它们打乒乓球、接长曲棍球和学习堆砌积木、打开冰箱门以及在同一台机器中操作时“保持礼貌”作为人类的空间。

不错的收获!图片来源: Haje Kamps (在新窗口中打开) / TechCrunch

机器人技术面临的有趣挑战是语言模型并非天生以物理世界为基础。他们接受过大量文本库的培训,但文本库不会与他们的环境交互,他们也不必过多担心会导致问题。当你让谷歌引导你到最近的咖啡店时,这有点好笑,而地图意外地绘制了一个 45 天的徒步旅行和一个三天的湖游。在现实世界中,愚蠢的错误会产生真正的后果。

例如,当提示“我把饮料洒了,你能帮忙吗?”语言模型 GPT-3 以“您可以尝试使用真空吸尘器”作为响应。这是有道理的:对于一些混乱,真空吸尘器是一个不错的选择,语言模型将真空吸尘器与清洁联系起来是有道理的。如果机器人真的这样做了,它很可能会失败:真空吸尘器不擅长泼洒饮料,而且水和电子设备不会混合,所以你最多可能会导致真空吸尘器损坏,或者最坏的情况是电器着火。

Google 的支持 PaLM-SayCan 的机器人被放置在厨房环境中,并经过培训,可以更好地在厨房提供帮助的各个方面。当收到指令时,机器人正在尝试做出决定。 “我在即将尝试的事情上取得成功的可能性有多大”和“这件事可能有多大帮助”。在这两个考虑之间的某个地方,机器人每天都变得越来越聪明。

取海绵机器人凯旋归来。图片来源: Haje Kamps (在新窗口中打开) / TechCrunch

可供性——或做某事的能力——不是二元的。平衡三个高尔夫球在彼此之上是非常困难的,但并非不可能。对于尚未展示抽屉如何工作的机器人来说,打开抽屉几乎是不可能的——但是一旦他们接受了训练,并且能够试验如何最好地打开抽屉,他们就会越来越自信地打开抽屉。任务。谷歌建议,未经训练的机器人可能无法从抽屉中取出一袋薯片。但是给它一些指导和几天的练习,成功的机会就会大大增加。

当然,所有这些训练数据都会在机器人尝试时进行评分。有时,机器人可能会以一种令人惊讶的方式“解决”一项任务,但对于机器人来说,这样做实际上可能“更容易”。

通过将语言模型与可供性分离,这意味着机器人可以“理解”多种不同语言的命令。该团队也在厨房展示了这一点,当机器人技术负责人文森特·范胡克用法语向机器人要一罐可乐时; “我们免费获得了语言技能,”该团队表示,并强调了用于训练机器人的神经网络如何足够灵活,从而为可访问性和普遍访问打开新的大门(字面上和比喻上)。

大多数触摸、打开、移动和清洁物体的机器人通常不会被邀请在人类附近进行操作。我们被鼓励保持距离,但研究人员似乎很自在,机器人在离无装甲人体几英寸的范围内自主运行。图片来源: Haje Kamps (在新窗口中打开) / TechCrunch

目前没有任何机器人或技术可用于商业产品,甚至不一定适用于商业产品。

“现在,这完全是研究。从我们今天的技能水平可以看出,它还没有真正准备好在商业环境中部署。我们是研究机构,我们喜欢做那些行不通的事情,”Vanhoucke 打趣道。 “在某些方面,这就是研究的定义,我们将继续努力。我们喜欢处理不需要扩展的东西,因为这是一种告知事物如何随着更多数据和更多计算机能力扩展的方式。你可以看到未来事情的发展趋势。”

谷歌的机器人实验室需要一段时间才能弄清楚其实验的长期商业影响(如果有的话),但即使在上周山景城展示的相对简单的演示中,很明显自然语言处理和随着谷歌的团队在如何训练机器人方面建立更深入的技能、知识和庞大的数据集,机器人技术都取得了胜利。