我最近写了一些关于人工智能的悲观文章,所以我想应该用一些乐观的观点来平衡一下。我认为人工智能真正能够帮助我们社会的一个方式,就是为我们的公共讨论注入理性与理性。

如今,我以友善理智的博主形象著称。但刚开始写博客的时候,2011年我还是个愤世嫉俗的研究生,为了逃避论文的压力,我写博客消磨时间,那时的我可是出了名的尖酸刻薄。现在回头重读那些早期的文章,我不禁莞尔,但也略感尴尬。那些高高在上的经济学界权威人士,根本不知道该如何应对一个尖酸刻薄、敢于反驳的千禧一代网络原住民。

那种略带讽刺的傲慢,虽然是真诚的,却让我(无意间)跻身意见领袖的行列。保罗·克鲁格曼、布拉德·德隆和其他一些知名博主喜欢我揶揄那些对财政刺激嗤之以鼻的古板的新古典宏观经济学家的方式。于是他们在自己的博客上推广我,很快,几乎经济学界的每个人都知道我的名字——不管名副其实。后来我注册了推特,开始疯狂发推,剩下的故事大家都知道了。值得一提的是,真正让我社交媒体粉丝数量激增的,并非我的经济见解,而是我的政治推文——2015-2020年间的反特朗普言论。

在1991年的媒体界,这条职业道路要难走得多。我或许可以成为报纸专栏作家,甚至电视节目主持人,但这将会是一条漫长而艰辛的道路,因为要被一群秉持老一辈传统观念的编辑把关。要想以一个特立独行、独立的声音闯入媒体圈,最好的选择或许是脱口秀广播。但在1971年的媒体界,想都别想——我根本不可能打入由电视广播和大型报纸主导的舆论场。

我们可以思考,如果我从未成为一名公共知识分子,世界会变得更好还是更糟(希望你读到这篇博客后,答案是“更好”)。但在我个人看来,很明显,局外人以咄咄逼人的态度和社交媒体博取关注的手段闯入公共话语,这种现象已经走得太远了。有非常确凿的证据表明,社交媒体——远比它所取代的传统媒体——助长了分裂性言论和不良行为者的崛起。

例如, Bor 和 Petersen (2021)发现,社交媒体吸引了一些心怀恶意、追求地位的人,他们利用敌意来获取关注和权力:

为什么线上政治讨论比线下讨论更具敌意?……我们通过八项研究,利用跨国调查和行为实验(总样本量N = 8,434),发现充满敌意的政治讨论源于那些受地位驱动、热衷政治且线上线下都同样具有敌意的个体。最后,我们初步证实,线上讨论之所以更具敌意,部分原因是这类个体的行为在线上比线下更容易被察觉。[重点为笔者所加]

从本质上讲,在社交媒体上散播仇恨和分裂是一种商业行为。正如尤金·魏所写,社交媒体的本质在于获取社会地位。在X平台上拥有1万粉丝或许听起来不足以媲美哥伦比亚广播公司新闻网(CBS News)的媒体帝国,但对大多数人来说,这比他们一生所能获得的关注还要多。对于那些渴望地位和关注、热衷于散播恐惧和仇恨的恶意之徒而言,社交媒体自然而然地成为了他们实现黑暗梦想的理想平台。

这一点尤其有效,因为病毒式传播内容的心理机制往往更容易传播负面信息而非正面信息。以下是Knutson 等人 (2024) 的研究:

我们分析了过去十年(2011-2020年)间来自182家美国新闻媒体(涵盖极左到极右的立场)在推特( twitter.com )上发布的约3000万条推文的情感倾向。结果显示,带有偏见的新闻媒体(无论左翼还是右翼)比立场中立的媒体产生了更多高唤醒度的负面情绪内容。高唤醒度的负面情绪内容也增加了带有偏见的媒体的转发量,而非立场中立的媒体……十年间,高唤醒度的负面情绪内容的传播速度也随之加快,尤其是在政治类推文中。综上所述,这些发现表明,高唤醒度的负面情绪内容可能促进了带有偏见的媒体新闻的传播。

Brady等人(2021)发现,社交媒体上的愤怒情绪是一个自我强化的过程:

道德义愤塑造着社会生活的基本方面,如今在网络社交网络中也十分普遍。本文展示了社会学习过程如何随着时间的推移放大网络上的道德义愤表达。在两项预先注册的Twitter观察性研究(7331名用户,共计1270万条推文)和两项预先注册的行为实验( N =240)中,我们发现,对义愤表达的积极社会反馈会增加未来表达义愤的可能性,这与强化学习的原理相符。

这些因素共同作用,或许可以解释为什么社交媒体上负面内容(尤其是关于人们政治对手的内容)比正面内容要普遍得多。以下是Watson等人(2024)的研究:

先前的研究表明,使用负面语言的新闻相关社交媒体帖子更容易被转发,这有利于发布负面内容的用户……来自美国和英国四家新闻网站(95,282 篇文章)和两个社交媒体平台(Facebook 和 Twitter 上共有 579,182,075 条帖子,现在归类为 X)的数据显示,社交媒体用户分享负面新闻文章链接的可能性是其他用户的 1.91 倍……用户更倾向于分享提及对立政治团体的负面文章。此外,考虑到用户转发包含文章链接的帖子,负面内容在社交媒体上对新闻传播的放大作用更为显著。这些发现表明,与在线新闻网站相比,Facebook 和 Twitter 上负面语气的文章更为普遍。

更糟糕的是,社交媒体平台还会通过算法放大分裂性内容,这很可能是一种商业策略!以下是Milli 等人 (2024) 的研究:

在预先注册的算法审核中,我们发现,相对于反向时间基线,Twitter 基于互动的排名算法会放大带有情绪色彩、敌视外群体的内容,用户表示这些内容让他们对自己的政治外群体感到更加不满。

研究还发现,算法推送往往会加剧政治极化。

换句话说,社交媒体的兴起引发了政治话语的革命。传统大型报纸和电视台的垄断地位——原本就因互联网以及日益增多的新进入者和竞争而岌岌可危——被一大群渴望成为“意见领袖”的人推翻,这些人利用分裂、党派之争、意识形态、部落主义和负面情绪来博取关注和地位。

我把这些人称为“叫嚣阶层”。其中最成功的包括尼古拉斯·富恩特斯(Nicholas Fuentes),他是个不折不扣的希特勒支持者,曾呼吁将女性送往“古拉格”集中营;坎迪斯·欧文斯(Candace Owens),一个阴谋论者和反犹主义者;以及哈桑·皮克(Hasan Piker),他曾声称美国咎由自取,应该遭受911袭击。但真正造成破坏的,或许是数量庞大的小喽啰,他们都梦想着成为下一个富恩特斯、欧文斯或皮克。如果你上过X或Bluesky,你大概能说出其中几个人的名字。

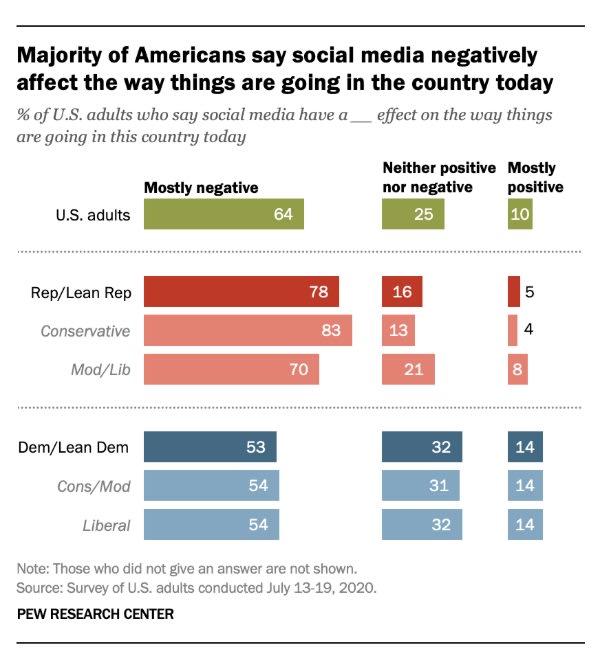

当然,普通人都知道,社交媒体是由形形色色的“怪物”掌控的。以下是2020年的一项民意调查,显示美国人认为社交媒体对他们的社会产生了负面影响:

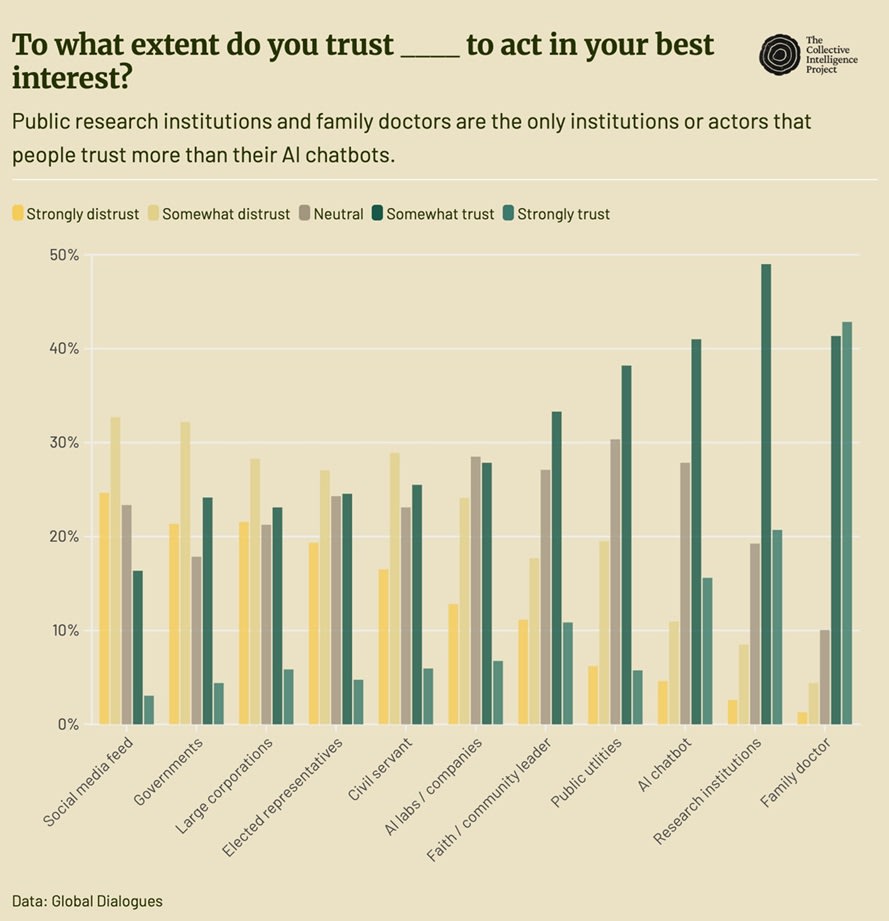

最近一项民意调查显示,美国人对社交媒体的信任度几乎低于其他任何机构:

越来越多的美国人正在远离社交媒体。但由于普通、温和的美国人率先离开,这反而将影响力拱手让给了极端分子。以上内容引自Törnberg (2025) :

整体而言,社交媒体平台的使用率有所下降,最年轻和最年长的美国人越来越倾向于完全放弃使用社交媒体。Facebook、YouTube 和 Twitter/X 的用户数量有所减少,而 TikTok 和 Reddit 的用户数量则略有增长……在各个平台上,政治帖子仍然与情感极化密切相关,因为党派立场最鲜明的用户也最为活跃。随着普通用户逐渐退出,而立场极化的党派人士仍然活跃,网络公共领域变得越来越小、越来越尖锐,意识形态也越来越极端。

当然,这并非新媒体技术首次为煽动分裂的企业家提供利用仇恨和恐惧来提升自身事业的机会。以20世纪30年代的右翼电台主持人查尔斯·考夫林为例,他曾呼吁终结民主,并将希特勒称为“英雄” 。考夫林的思想与如今的富恩特斯或塔克·卡尔森的思想有着明显的相似之处,他利用新媒体技术(广播)和持续不断的负面言论,成功打入公众视野,并确立了自己作为影响力人物的地位。

为什么查尔斯·考夫林式的媒体让位于20世纪中期稳重、中间派的大媒体?垄断权力。大型报纸逐渐建立起地方垄断,使得新兴媒体难以像几十年前那样依靠耸人听闻的报道打入市场。有限的频谱资源也使广播电视台和广播电台免受竞争。

随着新技术让新进入者得以突破壁垒,那些把关者不可避免地失去了权力。有线电视催生了肖恩·汉尼提、塔克·卡尔森和瑞秋·麦道等脱口秀主持人。广播脱口秀节目催生了拉什·林博和迈克尔·萨维奇。互联网则催生了像德拉吉报道这样的博客。所有这些新进入者都利用分裂和负面情绪来打入市场。社交媒体则加速了这一过程。

可以说,美国社会尚未从社交媒体兴起带来的冲击中恢复过来。其他一些社会由于其更高的同质性和中心化程度,似乎在一定程度上免受社交媒体的负面影响——但也只是略微如此。这个问题是全球性的。

现在的问题是,什么才能将我们从“叫嚣阶级”的暴政中拯救出来?谁能成为下一个沃尔特·克朗凯特?

我过去一直认为这是平台所有者自己的工作——如果他们真的想做,像埃隆·马斯克这样的人可以调整算法,审核内容,压制那些最具争议性的言论,奖励平衡和理性的内容。但我现在不这么认为了。看着Bluesky的管理层试图阻止平台走向疯狂却徒劳无功,看着埃隆的算法调整充其量只能带来轻微的保守观点转变,我对精明的企业管理层能否压制“聒噪阶层”的能力更加悲观了。而且,考虑到埃隆提拔了一些最糟糕的“聒噪阶层”成员,我对管理层想要成为CBS新闻频道的愿望也更加悲观了。

这就引出了人工智能的问题。

凡是使用过 X 的用户都会注意到“呼叫 Grok”功能。如果您是高级订阅用户,您可以随时标记埃隆最喜欢的 LLM(法学硕士),让它回答问题并提供相关事实。丹·威廉姆斯写道,这种 LLM 事实核查方式将把专业知识和技术官僚式的基于事实的分析重新引入公共讨论:

首先,与人类专家不同,法学硕士能够迅速运用其百科全书般的知识来解答人们提出的各种奇特问题。他们的回答可以被反复探究、仔细审查和质疑,而他们始终保持耐心和热情。他们不会简单地告诉你没有确凿的证据表明疫苗与自闭症之间存在关联,而是会耐心细致地向你解释我们掌握的证据类型,并解答你具体的疑虑。这在一定程度上解释了为什么他们能够如此具有说服力,甚至能够纠正许多人认为理性无法撼动的阴谋论观点。

其次,法学硕士通常以礼貌和尊重的方式分享信息。这不仅不同于社交媒体平台上许多辩论和讨论中那种表演式的、争斗式的氛围,而且也优于许多人类专家的沟通方式。作为人,专家往往带有偏见、党派倾向,甚至令人厌烦;当他们试图“教育”公众时,这种做法可能会被视为——有时甚至是故意为之——居高临下、粗鲁无礼。相比之下,法学硕士在提供专家意见时不会带有这种地位威胁。

事实上,有证据表明这种方法是有效的。尽管人们普遍担心人工智能会沦为确认偏误的机器——只会告诉人们他们想听的话——但雷诺等人(2026)发现,Grok 实际上是一个不错的事实核查工具:

我们利用2025年2月至9月期间在X平台上向Grok和Perplexity发出的1,671,841个英文事实核查请求的详尽数据集,首次对基于LLM的事实核查在实际应用中的运作方式进行了大规模实证分析……在两个LLM机器人评分的帖子中,Grok和Perplexity的评估结果有52.6%的时间一致,13.6%的时间强烈不一致(一方认为某个说法正确,另一方认为错误)。在100个经过事实核查的帖子样本中,Grok机器人评分与人工事实核查员评分的一致性为54.5%,Perplexity机器人评分与人工事实核查员评分的一致性为57.7%,显著低于事实核查员之间的一致性率64.0%;但Grok的API访问版本与事实核查员的一致性高于事实核查员的一致性,且与事实核查员之间的一致性没有显著差异。最后,在一项预先注册的调查实验中,1592 名美国参与者发现,接触 LLM 事实核查会显著改变信念的准确性,其效果与专业事实核查研究中观察到的效果相当。

事实上,尽管埃隆·马斯克不遗余力地让Grok减少“觉醒”倾向,但雷诺等人发现,这款人工智能更倾向于纠正共和党的帖子,而不是民主党的帖子。虽然这并不一定意味着现实本身带有自由主义倾向,但它确实表明,创建逻辑逻辑模型的人很难将自身的政治倾向传递给他们的作品。

Costello 等人 (2024)也发现,与人工智能对话会使人们减少对阴谋论的相信。

我希望法学硕士能成为事实核查机器和按需提供专业知识的渠道。但我认为,他们能够从“叫嚣阶层”手中夺回政治话语权,还有一个更重要的原因。由于他们接受的训练方式,法学硕士将成为推动观点同质化和温和化的力量。

这个想法在我脑海里盘旋已久,但我刚刚注意到迪伦·马修斯几个月前就写过这方面的内容:

某些通信技术在认知上具有分化性:它们的出现和传播导致受影响人群的现实感出现两极分化。通常这意味着,这项技术使人们能够接触到比技术出现之前更加多样化的观点和事实叙述……印刷术及其对16世纪欧洲宗教两极分化的影响就是一个经典的例子……当然,现代典型的分化性技术是社交媒体……

其他技术在认知上也在趋于融合:它们有助于使民众的视角趋于一致,并在民众之间构建一个不那么两极分化、更加共享的现实……从20世纪50年代到90年代的电视新闻网或许是这种融合的最佳例证……我的初步理论是,作为一种消费产品,LLMs(信息素养管理软件)将使人们对现实的感知更加趋于一致,这与社交媒体分裂人们的感知的方式形成了某种镜像……它们是集中式系统,除非你提示它们或提供背景信息,否则它们对每个人的行为基本相同。

我们来仔细分析一下。如果我是民主党人,我和别人谈论政治,那么我很可能是在和其他民主党人交谈。这种情况在社交媒体上比现实生活中更常见——我的一些邻居和同事可能是共和党人,但在X或Bluesky这样的平台上,我可以轻松找到其他民主党人。而这些民主党人大多也和其他民主党人交流,如此循环往复。于是,回音室效应就形成了,人们的观点不断被强化,并走向两极分化。如果我在网上和共和党人互动,那很可能是在对抗的语境下——我可能在对他们大喊大叫,或者他们也在对我大喊大叫,这只会让我更加坚定自己的民主党观点。

但当我与人工智能对话时,情况就不同了。人工智能的观点和信念来源于它的训练数据,而这些数据既包括民主党人也包括共和党人。我得到的不是我社交圈的平均观点,而是更接近全国平均水平的观点。如果人工智能真的有任何说服力,它最终会把我拉向中间立场。

人工智能确实具有说服力。Chen等人(2026)发现,近期推出的逻辑推理模型比竞选广告更具说服力。Hackenburg等人(2025)也发现了人工智能强大的说服能力。

因此,大多数沉默的群体(LLM)天然地起到了一种平衡作用——当人们与人工智能对话时,他们实际上是在间接地受到与他们意见相左的大多数人的观点的影响。这也意味着,大多数沉默的群体能够过滤掉极端观点。人工智能的训练数据来自比社交媒体上那些往往吸引眼球的极端言论者更广泛的人群;在大多数情况下,它自然会倾向于站在沉默的大多数一边。

这个过程最终应该会促使人们的观点更接近某种共识,无论这种共识是否正确。3 事实上,有一些证据表明人工智能会使人们的想法趋于同质化。这来自Sourati 等人 (2026) 的研究:

我们综合语言学、心理学、认知科学和计算机科学领域的证据,揭示语言学习模型如何反映并强化主流思维模式,同时边缘化其他声音和推理策略。我们考察了语言学习模型的设计和广泛应用如何通过反映训练数据中的模式,以及随着人们在不同情境下越来越依赖相同模型而加剧趋同性,从而导致这种现象。

以下内容摘自Jiang 等人 (2025) 的研究:

我们提出了一项大规模的LM模式崩溃研究,揭示了LM开放式生成中明显的“人工蜂巢思维”效应,其特征是(1)模型内部重复,即单个模型持续产生相似的响应,以及更显著的(2)模型间同质性,即不同模型产生惊人相似的输出。

乍听之下,这似乎不太好。我可不想人类变成真正的蜂巢思维!当然,我们也应该记住,虽然我们现在对20世纪50年代充满浪漫情怀,但当时的人们却感到被墨守成规所束缚。在无政府状态和“蜂巢人”之间,应该存在一种中间状态。

但如果你认为社交媒体已经把社会推向了无政府状态的极端,那么你就会欢迎一些回归共识的力量。如果每个人都互相攻击,一个国家就什么都做不成。分裂和两极分化也并没有使我们的信息空间“民主化”——它们边缘化了沉默的大多数温和派,并将思想的控制权拱手让给了社会上一些最极端的分子。从某种意义上说,人工智能通过赋予信息传播中心群体以话语权,或许比互联网本身更能真正地促进我们话语的民主化。

或许唯一能让我们免于出现一万个数字版查尔斯·考夫林的,就是数字版沃尔特·克朗凯特。

以及从训练数据生成的合成数据,偶尔也会从强化学习中获取数据(但更多用于数学和编程,而不是政治和辩论)。

有趣的是,Hackenburg等人发现,人工智能通过向人们抛出海量信息来说服他们,而这些信息往往是错误的;它常常降低人类信念的事实准确性。这提醒我们,信念的同质化和信念的缓和与事实性或教育并非同一概念;让所有人相信同一件事和让他们相信正确的事情是不同的任务。