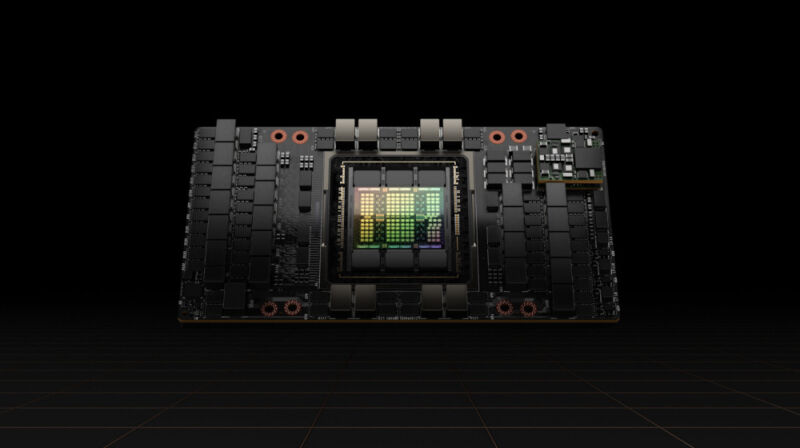

放大/ Nvidia H100 Tensor Core GPU 的新闻照片。 (信用:英伟达)

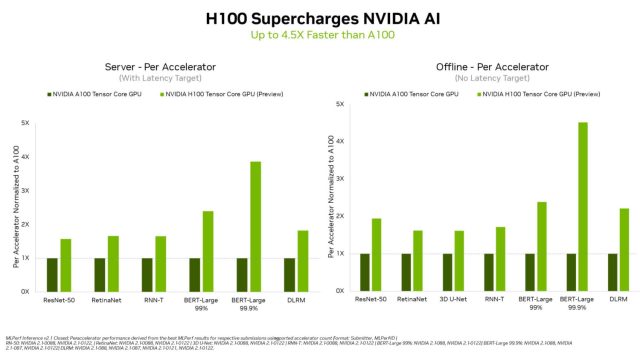

Nvidia 昨天宣布,其即将推出的H100 “Hopper”Tensor Core GPU 在行业标准MLPerf基准测试中首次亮相时创造了新的性能记录,其结果比目前 Nvidia 最快的量产 AI 芯片A100快 4.5 倍。

MPerf 基准(技术上称为“ MLPerfTM Inference 2.1 ”)测量“推理”工作负载,这表明芯片可以将先前训练的机器学习模型应用于新数据的程度。一组名为MLCommons的行业公司在 2018 年开发了 MLPerf 基准,以提供一个标准化的指标,用于向潜在客户传达机器学习性能。

特别是,H100 在BERT-Large基准测试中表现出色,该基准使用谷歌开发的 BERT 模型测量自然语言处理性能。 Nvidia 将这一特殊结果归功于 Hopper 架构的Transformer Engine ,它专门加速了 Transformer 模型的训练。这意味着 H100 可以加速类似于 OpenAI 的GPT-3的未来自然语言模型,它可以编写多种不同风格的书面作品并进行对话聊天。