今年二月,我的同事凯·威廉姆斯指出,法学硕士们有一种不可思议的能力,能够根据作者未发表的作品来识别他们。最近几周,像梅根·麦卡德尔和凯尔西·派珀这样的记者也证实了这一点。

我决定亲自试一试。2012年,一个朋友付给我500美元,让我写一篇关于加拿大枫糖浆大劫案的文章。这篇文章最终没有发表。所以上周五,我用隐身模式打开了ChatGPT,然后把文章里的五个段落粘贴了进去。

ChatGPT表示不确定作者是谁,猜测可能是Nate Silver或者我以前在Vox.com的同事Matthew Yglesias。当我又添加了四个段落后,聊天机器人回复说:“这篇文章我可以很肯定地确定作者是Timothy B. Lee。”

但当我问 ChatGPT为什么它认为这篇文章是我写的时,它却无法给出具体理由。“尽管 Timothy B. Lee 经常撰写清晰易懂的文章,但这篇文章中没有任何特征可以作为指纹——没有反复出现的短语、具体的政策框架,也没有已知的文章结构可以确凿地将其与他联系起来。”

我认为这里蕴含的教训远不止于识别作者。

人们拥有许多隐性知识——我们知道某些东西,但却难以完全解释清楚。人们常常用身体相关的比喻来描述这种现象。我们会说某个想法“就在嘴边却说不出来”,或者“一时半会儿说不上来”,又或者“凭直觉”就知道。

类似的情况也适用于LLM:他们执行认知任务的能力远远超过了他们明确解释自己如何以及为什么能够执行这些任务的能力。

但人和法学硕士之间存在着重要的区别。人脑是不断学习的;在我们日常生活中,大脑不断建立新的连接,识别新的模式,并形成新的直觉。我们内在的知识储备也在不断扩展。

相比之下,LLM 仅在训练期间进行这种操作。LLM 具有识别作者的惊人能力——但仅限于那些作品在训练数据集中得到充分体现的作者。一旦模型训练完成,其权重就会被固定,学习新模式(例如,新作者的写作风格)的能力也会大大降低。

最近,像Claude Code和OpenClaw这样的AI智能体引起了广泛关注。这种热度并非空穴来风。Claude Code确实正在革新计算机编程,而像OpenClaw这样的智能体也很有可能改变经济的其他领域以及我们的日常生活。

行业领袖预计,在不久的将来将出现更大的变革。 上个月,Sam Altman在接受采访时表示,OpenAI的目标是在2028年3月前打造一个“自动化AI研究员”。一些人认为,这一成果(或竞争对手的类似突破)将引发一个递归式的自我改进循环,从而大幅加速科学技术进步。

这或许最终会发生,但我认为需要一段时间。

人类科学家在进行实验时,他们的大脑会努力从数据中寻找模式,以期获得新的洞见,并构建关于世界运行方式的新模型。但人工智能科学家——至少是基于当今的逻辑逻辑模型和智能体架构的人工智能科学家——却无法以同样丰富的方式从实验中学习。他们缺乏可靠且可扩展的方法,无法从推理阶段所看到的数据中构建隐性知识。

解决这个问题可能需要从根本上重新思考当今前沿模型的核心——Transformer架构。至少,这需要彻底改造现有的智能体框架。

代理人如何应对有限的LLM情境

许多高难度的智力任务需要长时间的“思考” 。然而,逻辑学习模型(LLM)的工作记忆(称为上下文窗口)只能存储有限数量的词元。对于主流模型而言,这个限制在过去几年里一直徘徊在100万词元左右。此外,由于经济限制和上下文腐烂问题(我在11月份的文章中讨论过),人工智能开发者们尽量将词元数量控制在远低于最大值的水平。

如何应对这种矛盾一直是人工智能行业的重点,该行业开发了一系列“上下文工程”技术,旨在高效利用上下文信息。例如,现代聊天机器人会进行信息压缩,定期删除或总结较旧的信息。

这会造成一种错觉,让人以为模型拥有比实际更长的上下文信息。但如果压缩过程出错,就会带来严重的后果。在一个令人震惊的案例中,一位女士要求她的AI助手推荐要删除的电子邮件,但不要实际删除它们。不幸的是,后一个要求在压缩过程中丢失了,因此助手开始批量删除她的电子邮件。

过去一年,人工智能公司一直在尝试让模型在上下文窗口之外存储持久信息。Claude Code就是朝着这个方向迈出的一步。Claude Code 运行在用户的计算机上,可以读取和修改本地硬盘上的文件。一旦 Claude Code 完成特定的编码任务,它就可以将结果写入相应的文件,不再需要将细节信息保留在上下文中。

OpenClaw于 2025 年底发布,它更进一步。它是一个通用框架,用于在用户本地计算机上运行 AI 代理。OpenClaw 代理(类似于 Claude Code 代理)可以读写本地文件系统上的文件,从而存储相关文档并跟踪未完成的任务。

人们对 OpenClaw 和其他本地代理的热情带动了苹果 Mac mini 电脑的需求激增。在 Mac mini 上安装 OpenClaw 后,代理即可连接到 iMessage 等苹果服务。同时,由于 macOS基于 Unix ,代理还可以访问功能强大的命令行界面——Unix shell。

“说到底,你的经纪人只不过是那些档案而已。”

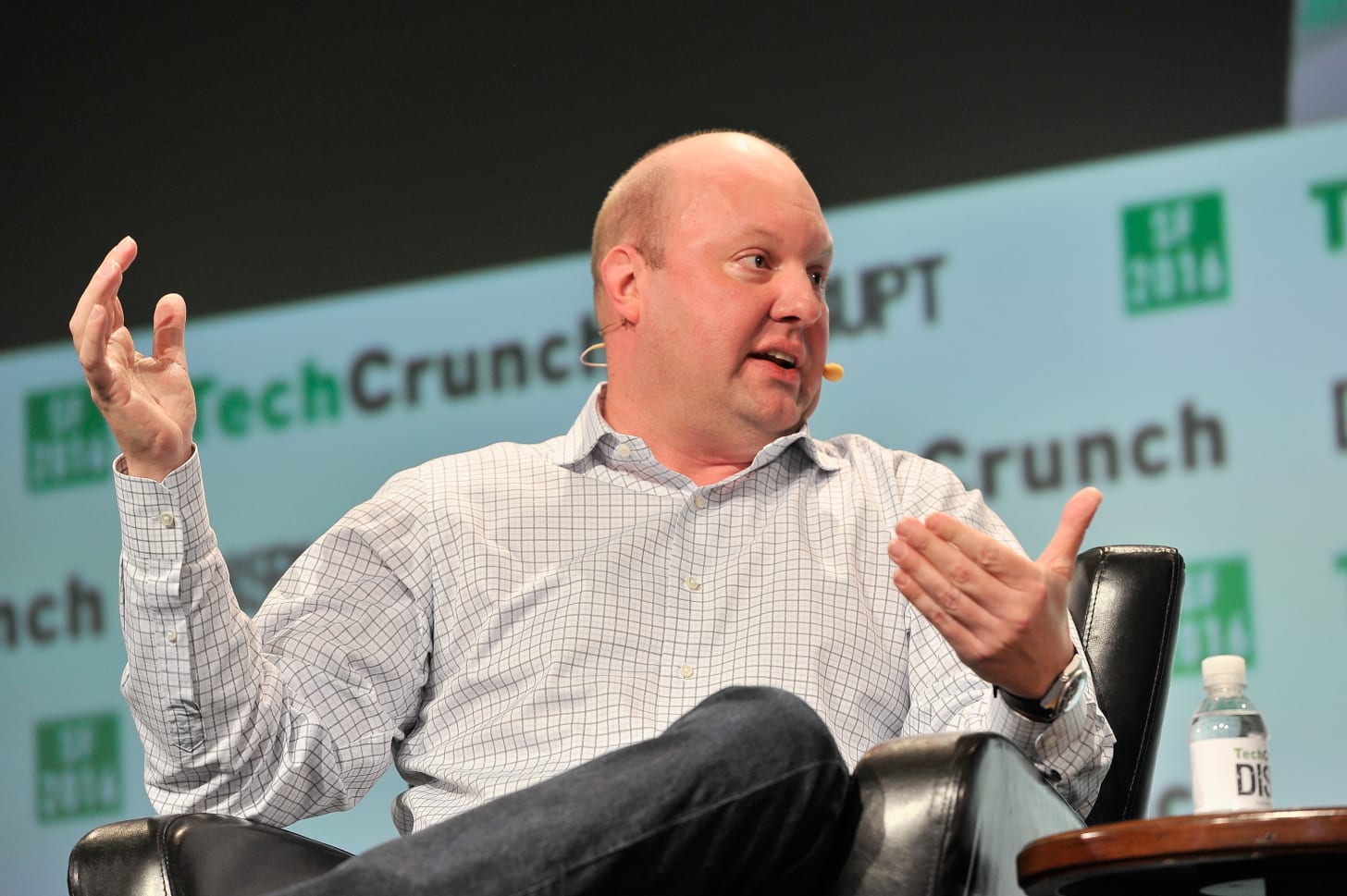

在最近一次做客 Latent Space 播客节目时,风险投资家马克·安德森 (Marc Andreessen) 认为,像 OpenClaw 这样的智能体代表了一种重要的全新计算范式。以下是略作编辑的节选:

我们现在知道,代理包含以下几个部分:它是一个语言模型,一个Unix shell (代理可以访问该 shell),一个文件系统(状态存储在文件中,文件采用Markdown格式),以及一个在 Unix 中被称为cron 任务的循环和心跳机制,代理通过这些机制启动……

这就是架构。那么,你的代理是什么呢?你的代理就是存储在文件系统中的一堆文件。

这意味着你的代理程序独立于它运行的模型,因为你可以更换代理程序底层的不同逻辑层模型(LLM)。虽然模型不同会导致代理程序的某些特性有所改变,但存储在文件中的所有状态都会被保留。它仍然是你的代理程序,拥有所有记忆和所有功能。

你还可以更换 shell,也就是将其迁移到不同的执行环境。你也可以更换文件系统,甚至更换心跳机制、cron 框架以及代理框架本身。归根结底,你的代理程序其实就是它的文件集合。

因此,代理可以进行自我迁移。您可以指示代理将自身迁移到不同的运行时环境、不同的文件系统或更换语言模型。代理会为您完成所有这些操作。

这个代理拥有完全的自省能力。它了解自身的文件,并且可以重写自身的文件。而这引出了一个让我彻底震惊的功能:你可以指示代理向自身添加新的功能和特性。

所以你在聚会上遇到一个人,他/她会说:“哦,我的 OpenClaw 可以做到很多事——连接到我的Eight Sleep 床垫,它能给我提供更好的睡眠建议。”于是你晚上回家——或者在聚会上——就对你的 OpenClaw 说:“给自己也添加这个功能。”

你的机械爪会说:“好的,没问题。”它会连接互联网,找到所需的信息,然后写入所需的数据,接下来,它就拥有了这项新功能。你甚至无需做任何事情,只需告诉它你想这样做即可。

这种范式出现才几个月,所以我预计它在未来几年内会有显著的发展。例如,目前还不清楚未来大多数人工智能代理是会在用户的本地计算机上运行,还是会有更多的人使用类似 OpenClaw 的、在云端虚拟机上运行的代理。但我认为 Andreessen 的观点是正确的,这是一种重要的全新计算范式。

与此同时,安德森的言论也凸显了我对当今人工智能模型能否达到人类智能水平仍持怀疑态度的一个重要原因。其中最让我印象深刻的一句话是“你的智能体只不过是它的文件而已”。我认为有必要深入探讨这句话对人工智能未来能力的影响。

办公室里的“Memento”

2000 年的电影《记忆碎片》讲述了一个患有短期记忆丧失症的主人公的故事。为了应对这种情况,他定期写下笔记,为未来的自己提供指导和指示。OpenClaw 也采用了类似的方法——语言模型本身会定期重置上下文窗口,但智能体通过给自己写笔记来保持逻辑连贯性。

举个例子。假设你需要一名员工,但你不是雇佣正式员工,而是通过一家临时工中介公司每周派不同的人来工作。

每周结束时,工人都会花费几个小时仔细记录一周的工作情况。

每位临时工入职时都接受过与其行业和职业相关的通用培训。因此,周一早上开始阅读时,他们只需学习与这份特定工作相关的信息,而无需学习业内人士普遍了解的背景知识(毕竟,法学硕士课程的学习基础是涵盖广泛领域的通用知识)。他们可能没有时间阅读前任撰写的所有内容,但笔记组织有序,他们可以使用搜索工具快速找到最相关的文档。

这种安排效果如何?这取决于工作的性质。有些工作——比如接待员、药剂师、水管工——本质上是事务性的。员工无需在每次预约之间记住太多细节,所以每周由不同的人提供服务也无关紧要。

但有些工作非常依赖背景信息。有些人与同一批客户合作多年,在此过程中深入了解他们的情况和目标。而另一些工作则要求员工花费数周甚至数月的时间进行深入研究,以获得新的见解。

像这样的工作,新员工可能需要一周多的时间阅读才能“跟上进度”。

2010年我在谷歌实习。我的第一个任务是向内部数据库添加一列。这只需要几行代码。但我花了几个星期的时间阅读资料,才充分了解谷歌的系统和开发流程,最终完成了这几行代码。

这并非编程行业独有的问题。在许多知识密集型行业,新员工至少需要几个月的时间才能充分了解工作内容并开始创造价值。在此之前,员工需要大量的“手把手”指导,以至于经理亲自完成这项工作反而更快。在这样的行业里,员工一周就离职是行不通的。

隐性知识与显性知识

我知道批评者会怎么说:人工阅读一份十万字的文档需要几个小时,而LLM(语言学硕士)只需几秒钟就能完成。如果基于LLM的编码代理在2010年就已经存在,那么对谷歌数据库进行一次微小的修改也不会花费数周时间。

LLM 的速度意味着 OpenClaw 式代理的一次迭代就能为后续迭代留下非常详细的笔记。这也意味着 OpenClaw 可以在人类工作者完成一次读-操作-写循环所需的时间内,完成数百次迭代。

这或许意味着OpenClaw智能体的能力远超我之前用人类类比所暗示的。经过数千次迭代,它们甚至可能在相当棘手的问题上取得进展。

这话说得有道理,但我认为很多人类工作仍然遥不可及。

四年前,我写了一篇文章,探讨“贪婪型工作”的概念——这类工作中,员工投入的时间越长,每小时的收入往往越高。工作之所以会变得“贪婪”,原因有很多,但一个重要因素是,知识型员工往往经验越丰富,工作表现就越好。经验越丰富——例如,拥有更广阔的视野——这种优势可以在长达数十年的职业生涯中不断累积。

例如,我从事科技和经济领域的写作已有20余年。我写过英国脱欧、 专利流氓、激光雷达传感器以及其他许多话题。在任何特定时刻,这些知识大多与我正在写作的主题无关。但总的来说,这些知识积累增加了我在任何特定话题上都能提出有趣见解的概率。

如果我把所有知道的东西都写下来,然后交给其他记者,指望她能像我一样出色地完成工作,那完全不切实际。这不仅仅是因为我需要花几个月的时间才能总结出我二十年职业生涯中所学到的一切,更重要的是,我还有很多隐性知识不知道该如何用语言表达出来。

我明确表达的观点——那些我能在谈话中清晰阐述或在邮件中写下来的东西——只是冰山一角。水面之下隐藏着更多隐晦的直觉、模糊的联想和尚未成型的理论。由于这些内容是隐性的,因此很难传递给其他人。但对我来说,做好工作至关重要。

我那些可以发表的顿悟往往源于直觉。在找到证明方法之前,我就已经确信某件事是正确的。很多时候,我需要反复思考一个想法几个小时甚至几天,才能把它清晰地表达出来。

而且我认为我并非个例。科学家、工程师、商业领袖以及许多其他知识密集型职业人士似乎也都有同样的感受。许多真知灼见最初都只是人们脑海中隐隐约约的想法——或者说“话到嘴边却说不出口”——之后才有人想出如何将其转化为英语、Python 或其他任何明确的语言形式。

正如我之前讨论过的,逻辑推理机器确实拥有类似的隐性知识。但即便不是全部,大部分隐性知识也是在它们最初的训练过程中习得的。逻辑推理机器似乎缺乏持续学习的能力:即在推理过程中识别新模式并形成新推测的能力。

此外,LLM 在特定会话期间积累的任何隐性知识都会在代理框架将控制权从一个 LLM 实例移交给下一个实例时丢失。在此过渡期间,代理所知道的一切都会被存储在一组外部文件中——正如 Andreessen 所说,“你的代理就是它的文件”。根据定义,隐性知识——代理无法用自然语言、代码或其他显式形式解释的知识——无法在这种交接过程中保留下来。

我强烈预感,这些未经深思熟虑的想法正是人们用来构建对世界独到见解的原材料。因此,我怀疑至少在未来几年内,我们需要人类工作者来替我们进行深度思考。

感谢Daniel Kagan-Kans 、 Andrew Lee 、 Steve Newman和Nat Purser对本文初稿提出的反馈意见。

原文: https://www.understandingai.org/p/i-dont-think-we-are-close-to-ai-scientists