一、旧梦

自人类诞生以来,我们就渴望扮演上帝的角色,创造生命。我们流传着关于泥人(Golem)的故事,它们用黏土捏成,空心的头骨里被植入文字,“emet”代表真理,“met”则代表死亡。从11世纪的所罗门·伊本·加比罗尔(Solomon ibn Gabirol)创造女性泥人来做家务(这很贴近生活),到孩提时代就尝试制作泥人的维尔纳·加昂(Vilna Gaon),亚历山大的希罗(Hero of Alexandria)制作了精巧的机械和液压装置、自动移动的人偶和人造鸟。

20世纪也不例外,只不过当时的“魔像”变得更加逼真了。此时,你或许不会惊讶地发现,几乎参与了所有其他发现的约翰·冯·诺伊曼认为计算机可以模拟和创造生命!他构想了一种“通用构造器”,一种可以建造其他机器的机器。他还提出了元胞自动机的概念。

首届人工生命大会(ALife )于1987年召开。大会致力于探索更为温和的模拟生命形式,即在新兴的数字平台上模拟生命。康威生命游戏便是早期的一个例子。它规则简单,但反复应用这些规则却能产生复杂的现象。

对此已有大量探索,这些探索依赖于构建简单的规则,并观察当初始条件与这些规则反复组合时所产生的复杂性。即使是受生物进化启发、采用某种形式的变异和选择的类似简单算法,也能有效地做到这一点。他们认为生命的基础是一套固定的规则,而需要涌现的复杂性则取决于正确的迭代次数。

我们身边充满了像这样的复杂现象。天气受流体动力学的纳维-斯托克斯方程控制,这是一个确定性系统,但由于非线性而变得混沌。著名的蝴蝶效应,正如爱德华·洛伦兹在他的天气模拟中发现的那样,他将一个变量从0.506127四舍五入到0.506,结果却发生了巨大的变化。

沃尔夫勒姆以此理论为基础,开创了一种全新的科学。他认为这是思考计算复杂性如何从简单的起点演变而来的绝佳方式。你可以从重复应用的简单规则出发,最终得到极其复杂的系统,但要从最终形态推断出最初的规则却并非易事。

或许可以说,这项技术目前尚未完全成功。我们了解了自组织、涌现以及一些进化的基本原理。但创造生命的梦想仍然只是一个梦想。

二、脱离生物学的进化

进化算法是我们尝试的另一半。如果说元胞自动机表明,重复应用简单的规则或许足以构建复杂的系统,那么进化策略则表明,你甚至不需要了解设计,只需创建变体,选择有效的变体,对其进行变异,然后让搜索机制完成你无法亲自完成的繁琐工作。

这招真的管用!进化算法能够发现一些奇特的技巧,比如控制模拟物体行走的控制器、天线、电路以及神经网络权重,这些都是工程师们绝对不会故意编写的。CMA -ES就是这种算法的成熟版本之一:它是一种用于解决棘手黑盒优化问题的进化策略,尤其适用于梯度计算困难的情况。

Avida更进一步,构建了能够在晶格上复制、争夺空间、变异和进化的数字生物体。从中可以看到一些我们通常与生物学联系起来的特征:寄生虫、鲁棒性、奇特的偶然性,以及系统能够在程序员未明确编写的可能性空间中找到路径的感觉。

新奇搜索和POET类型的研究注意到了这一点,并意识到需要同时生成环境和智能体!问题不在于进化需要一个目标。有时,目标本身就是问题所在。如果优化过于直接,就会陷入局部智能的怪圈,无法自拔。而实际上,环境并非静止不变,智能体会与周围环境共同进化。

人们对这种可能性感到非常兴奋,认为这或许是通往计算机科学世界的一条途径。但最终发现问题依然存在:这些世界非常单薄!基因组很短,突变很简单,“身体”也很简单,生态系统过于狭窄,目标函数也远不够复杂或富有表现力。

我不认为这说明突变和选择的力量很弱。恰恰相反,它们太强了。它们不断地在资源不足以永远奖励这种聪明才智的世界中寻找巧妙的进化策略。或许进化需要发生在一个完整的世界中,而不仅仅是一个袖珍宇宙。这或许才是关键所在。人造生命拥有进化,但它所处的世界却不够丰富。

三、缺失的机械

与这些程序相比,真正的生物学简直丰富得令人难以置信。从微小的基因改变到我们后来称之为性状的事物之间,竟然存在着如此庞大的机制,而且随着抽象程度的提高,其复杂性还会呈爆炸式增长,这真是令人尴尬!

生物学真的非常非常复杂,我们对它的了解还少得可怜。我们构建的最小的合成细胞JCVI-syn3.0拥有 473 个基因,按生物学标准来看,这简直微不足道。而且,在它被制造出来的时候,其中 149 个基因的生物学功能仍然未知!即使我们将细胞简化到极致,仍然有大约三分之一的基因功能成谜。

人类的情况更复杂。我们只有大约2万个蛋白质编码基因,而这些基因只占基因组的不到2% 。这听起来似乎意味着我们很简单,但事实并非如此。剩下的部分涉及调控、RNA、剪接、染色质、时序、细胞信号传导、组织力学、发育,以及身体不断地被环境解读等诸多方面。ENCODE项目在人类基因组中发现了数十万个候选调控元件。你不可能像读麦片盒上的成分表一样,仅仅通过读取基因列表就能构建出一个完整的人类。

基因并非性状。基因是一条指令,它在特定时间、特定组织内的细胞中,在局部化学梯度的作用下,受到来自上下反馈的调控。DNA转化为RNA,RNA转化为蛋白质,蛋白质调控其他蛋白质,细胞解读信号,组织约束细胞,生物体改造环境,环境选择生物体,整个过程循环往复,最终看似运转良好,尽管有时它并没有按照我们认为的常规方式运作。

这就是为什么“突变加选择”这种说法虽然正确,但却不够全面。ALife借鉴了突变和选择的概念。但我们没有像基质那样复杂的机制,在基质中,微小的变化就能演变成系统层面的连贯变化,因为系统本身就包含大量用于解读这种变化的遗传结构。

或者更确切地说,我们之前没有一个足够强大的环境供模型学习和演化。这正是现代人工智能所创造的契机。基础模型本身并非活物,而是基于对现实世界痕迹的学习先验知识。它见证了语言、代码、图像、人类计划、错误、物体、惯例、物理学知识、生物学知识,以及所有丑陋的、反映现实的统计残余。在一个进化系统中,它的作用与其说是生物体本身,不如说是发育机制:将微小的突变转化为大规模、连贯的表型变化。

四、人工智能

事实证明,我们还可以采用另一种方式来构思创造具有生命形态的现象。这与我们之前使用元胞自动机的方法截然相反。这种方法并非从规则入手生成复杂性,而是从海量的复杂数据出发,试图发现其中的潜在模式。

所有数据都编码着反映潜在结构规律的规律和统计模式。训练后的网络会从示例中“吸收”这些模式,并最终确定一套参数配置,从而生成与这些模式相符的行为。

它的效果好得惊人!许多人甚至认为我们已经有了意识的萌芽。

然而,这种方法存在一个问题。与第一种方法相比,我们并不确切地知道网络学习到了什么。它可能学习到了产生我们周围所见复杂性的底层规则,也可能学习到了构成无法缩放的本轮的统计模式。

语言的成功之处如今让我们深思。我们曾以为人类语言混乱不堪,但它似乎也蕴含着巨大的冗余和结构。它们的成功取决于现实世界数据中那种丰富的模式,而非任意和完全随机的复杂性。

这也意味着,学会使用语言的事物也学会了最常用的语言类型,即,不是柏拉图式的语言,而是能够实际交流所要表达的任何内容的语言。

五、不确定性

如果你把深度学习神经网络想象成一个存储训练过程中涌现出的模式的库,这些模式不仅来自数据本身,也来自数据的推导过程,其中一些甚至我们肉眼无法看到,那么这说明了什么?它能学习到的模式数量呈组合爆炸式增长。

这是赫克托·勒维斯克一直以来的担忧:统计学习在很久以前就看起来像是理解了事物,而我们却不知道它是否真的学习了其背后的因果结构。

这里我想起了道格拉斯·亚当斯关于同义反复的论述:

“同义反复是指,如果它没有任何意义,不仅意味着它没有包含任何信息,而且也没有任何后果。”

我们训练这些模型的方式也是一种奇特的同义反复。训练过程看似循环往复,但实际上并非空无一物,因为数据本身蕴含着结构,而模型架构、目标函数和表征约束决定了最终能够呈现哪些结构。问题不仅在于模型是否压缩了世界,更在于它找到了哪种压缩方式。

人工生命经历了进化,但世界不够广阔。现代人工智能拥有世界,至少拥有足够广阔的世界,但却没有定向进化。或许,下一次创造生命的尝试,正是将这两次失败结合起来。如同许多论文一样,黑格尔的综合理论为我们指明了前进的方向。

因此,如果我们能够使模型像一个学习物理引擎一样运作,对语言、代码、图像、文化和现实世界的片段进行密集、有损的编码,那么进化或许就可以在这个基质中运作:产生小的变体,测试它们,淘汰代价高昂的变体,保留有用的变体,让专家出现,让它们融合,等等?

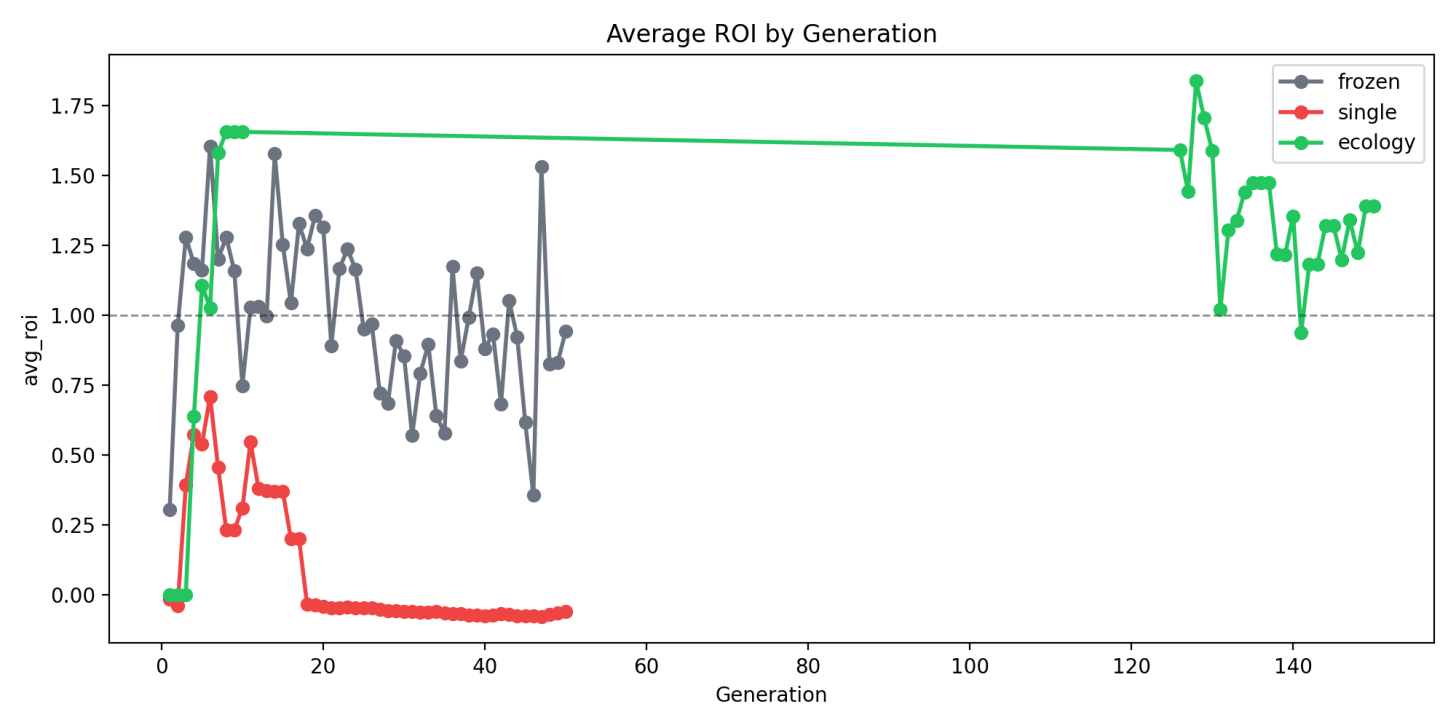

这是我的推测。所以我尝试用Evolora来验证它。我把整个模型冻结成一个世界,让小型 LoRa 适配器作为生物体或细胞器存在于其中。我给它们收取能量代币,为它们的有用行为支付报酬,破产意味着死亡,盈利意味着繁殖,成功的适配器融合形成后代。我把它构建成一个语义生命游戏。

它目前仍处于趣味玩具阶段,但趣味十足。任务和环境都受到限制。其开放性尚需大规模验证。然而,在准生命意义上,已经出现了一些生命的迹象:生态位、合并、能量压力、专家、路径规划、小型群体,以及一些进化组合似乎比单一训练好的适应者更具稳健性的地方。

这就是人工智能的未来吗?我们能否将从任意数据中学习的优势与通过重复应用规则创造复杂性的优势结合起来?如果说过去的梦想是让塔洛斯拥有流淌着神血的血液,那么新的梦想则更加奇特。或许我们必须进化出一整套生态系统,学习如何在我们训练过却并不真正理解的世界中生存,而不仅仅是创造一个人工生物。我们已经从黏土、神血和人造人那里走了很远。虽然还不足以创造真正的生命,但或许足以制造出一个更好的仿制品,以便从中学习。

感谢阅读《奇异循环正典》!免费订阅即可接收最新文章并支持我的创作。

原文: https://www.strangeloopcanon.com/p/artificial-life-artificial-intelligence